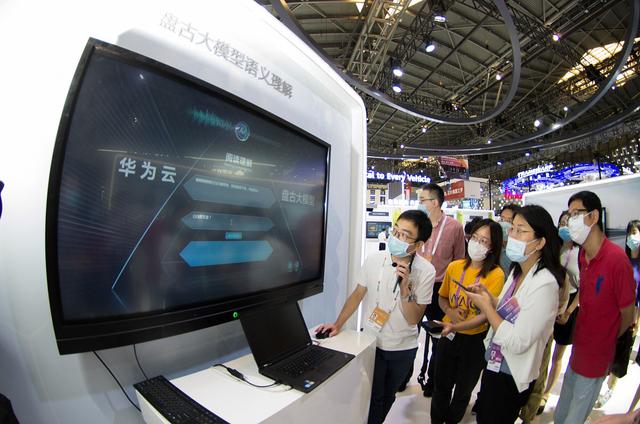

华为盘古大模型是华为公司最新推出的AI语言模型,该模型的命名取自中国神话中的盘古开天辟地的故事。该模型在2021年4月正式发布,是华为公司在人工智能领域的一次重要突破。

华为盘古大模型与ChatGPT有何不同?这是一个非常值得探讨的问题。本文将从模型的基础架构、技术优势和应用场景三个方面来分析和比较这两个模型。

一、模型基础架构

1.1 华为盘古大模型

华为盘古大模型是基于Transformer模型架构构建的,使用了深度学习技术进行训练。模型的参数量达到了2.6亿个,是目前世界上最大的中文预训练模型之一。该模型包括多个子模型,其中最大的子模型包含了1.4亿个参数。

1.2 ChatGPT

ChatGPT也是基于Transformer模型架构构建的,使用了深度学习技术进行训练。该模型的参数量达到了1.5亿个,是目前较为流行的英文预训练模型之一。

从基础架构来看,华为盘古大模型和ChatGPT都采用了Transformer模型架构,但是华为盘古大模型的参数量比ChatGPT大得多。这也意味着华为盘古大模型在处理更复杂的任务时,具有更强的表达能力和推理能力。

二、技术优势

2.1 华为盘古大模型

华为盘古大模型的技术优势主要体现在以下几个方面:

(1)大规模预训练:华为盘古大模型采用了大规模预训练的方法,通过对大量的中文语料进行预训练,使模型具有更强的泛化能力和适应能力。

(2)多任务学习:华为盘古大模型采用了多任务学习的方法,通过同时训练多个任务,使模型能够在不同的任务中具有更好的表现。

(3)知识蒸馏:华为盘古大模型采用了知识蒸馏的方法,通过将已训练好的小模型的知识迁移到大模型中,从而提高大模型的性能。

2.2 ChatGPT

ChatGPT的技术优势主要体现在以下几个方面:

(1)自回归语言模型:ChatGPT是一种自回归语言模型,可以生成连续的文本序列。

(2)非监督学习:ChatGPT采用了非监督学习的方法进行训练,不需要标注数据,可以利用大量的未标注数据进行预训练。

(3)Fine-tuning:ChatGPT可以通过Fine-tuning的方法进行微调,使其适应不同的任务。

从技术优势来看,华为盘古大模型和ChatGPT都采用了大规模预训练和多任务学习的方法,但是华为盘古大模型还采用了知识蒸馏的方法。此外,ChatGPT是一种自回归语言模型,可以生成连续的文本序列,而华为盘古大模型的应用场景更加广泛。

三、应用场景

3.1 华为盘古大模型

华为盘古大模型在以下几个领域具有广泛的应用场景:

(1)智能客服:华为盘古大模型可以用于智能客服,回答用户的问题。

(2)智能写作:华为盘古大模型可以帮助写作者生成文章的开头和结尾,提高写作效率。

(3)智能翻译:华为盘古大模型可以用于智能翻译,将中文翻译成其他语言。

3.2 ChatGPT

ChatGPT在以下几个领域具有广泛的应用场景:

(1)智能客服:ChatGPT可以用于智能客服,回答用户的问题。

(2)智能写作:ChatGPT可以帮助写作者生成文章的开头和结尾,提高写作效率。

(3)智能聊天机器人:ChatGPT可以用于智能聊天机器人,与用户进行对话。

从应用场景来看,华为盘古大模型和ChatGPT的应用场景相似,都可以用于智能客服、智能写作等领域。但是华为盘古大模型还可以用于智能翻译,具有更广阔的应用前景。

华为盘古大模型和ChatGPT都是基于Transformer模型架构构建的,使用了深度学习技术进行训练。两个模型都采用了大规模预训练和多任务学习的方法,但是华为盘古大模型还采用了知识蒸馏的方法。从应用场景来看,两个模型的应用场景相似,但是华为盘古大模型还可以用于智能翻译等领域。因此,华为盘古大模型在处理更复杂的任务时,具有更强的表达能力和推理能力,同时具有更广阔的应用前景。

举报/反馈

原文链接:https://baijiahao.baidu.com/s?id=1762681463379441880&wfr=spider&for=pc

评论 ( 0 )