近期,伴随着ChatGPT带来的鲶鱼效应,人工智能成为科技产业创新的焦点,科技产业龙头正加大在人工智能领域的军备竞赛。算法、数据、算力作为人工智能领域的三要素,也同时受到了业内关注。其中,算力是军备竞赛的重点,相关企业正在加速布局。

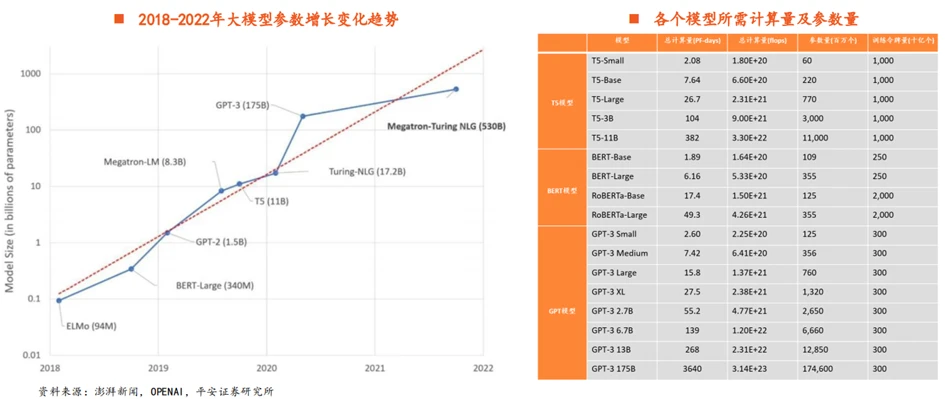

生成式AI需要基于海量自然语言或多模态数据集训练,拥有巨大参数量的超大规模AI模型,所需AI算力当量显著提升。例如,以PD(Petaflops-Day)为单位来衡量,GPT-3大模型训练的算力当量为3640PD。超大规模AI大模型训练一般须在大规模AI服务器集群上进行,AI服务器、AI芯片等算力相关市场需求有望提升。

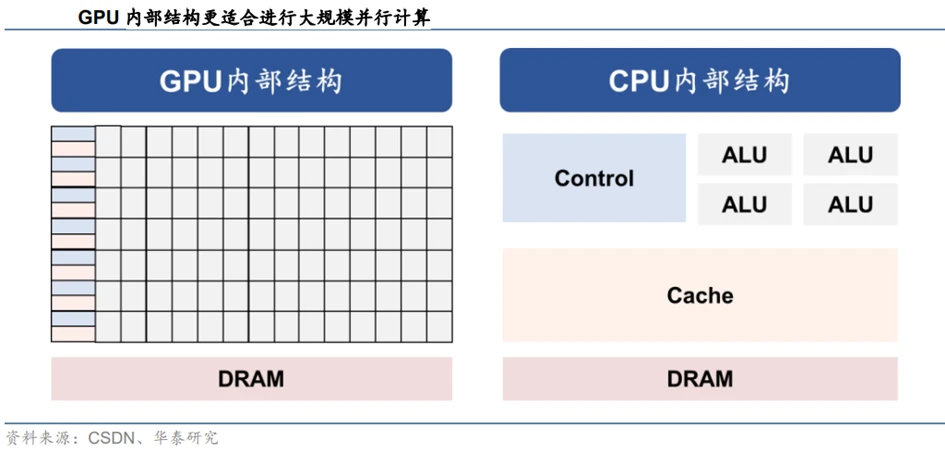

在AI时代,传统算力面临挑战。普通服务器采用串行架构,主要以CPU提供算力,在进行逻辑判断时需要大量分支跳转处理,CPU结构复杂,算力提升主要依靠核心数的数量提升。随着目前CPU制程工艺已经让单个CPU的核心数接近极限,而爆炸式增长的数据、逐步复杂的算法模型、不断深入发展的应用场景,使得对算力能力和算力规模的需求快速提升,普通服务器已无法满足不断增长的算力需求。

以下我们就将对当前比较火热的AI算力话题进行探讨分析,从当前产业现状、供需格局出发,分析梳理AI算力发展的关键环节—AI服务器和AI芯片的产业现状和格局,及当下产业瓶颈及突破路径,同时对算力产业链及相关企业、细分受益环节、产业发展前瞻等进行分析,以全面了解AI算力当下发展状况及未来发展趋势。

01

产业概况

1、相关概念

算力是人工智能三要素之一,已成为人工智能产业化进一步发展的关键。所谓算力,就是计算能力,是指对数据的处理能力,它被视为数字经济时代的新生产力,是推动数字经济发展的核心力量。

其中,算力的大小代表着对数字化信息处理能力的强弱。从原始社会的手动式计算到古代的机械式计算、近现代的电子计算,再到现在的数字计算,算力指代了人类对数据的处理能力,也集中代表了人类智慧的发展水平。

伴随着云计算技术和5G通信技术的发展,使得算力的分布和调度更加灵活,有助于满足各种场景下对高性能计算的需求。未来随着技术的进步和应用场景的不断拓展,算力将继续发挥重要作用,推动整个人工智能行业的创新和发展。

2、算力:ChatGPT发展的核心基础底座

ChatGPT能够实现当前如此强大的交互,离不开背后庞大的算力支撑。根据绿色节能数据中心官方公众号,ChatGPT的总算力消耗约为3640PF-days。按近期在国内落地的某数据中心为参照物,算力500P耗资30.2亿落成,若要支持ChatGPT的运行,需要7—8个这样数据中心支撑,基础设施投入需以百亿计。

因此,随着AI等新技术的发展,对高可靠、高性能、高安全算力需求更加突出,全球正掀起一场算力的“军备竞赛”,数据中心、AI芯片、服务器等环节作为算力基础设施,有望被高度重视。

3、AI算力市场呈高速增长态势,算力成为AI突破的关键因素

数据、算力及算法是人工智能发展的三要素。在这三要素中,数据与算法都离不开算力的支撑。随着AI算法突飞猛进的发展,越来越多的模型训练需要巨量算力支撑,才能快速有效实施,同时数据量的不断增加也要求算力配套进化。如此看来,算力成为AI突破的关键因素。

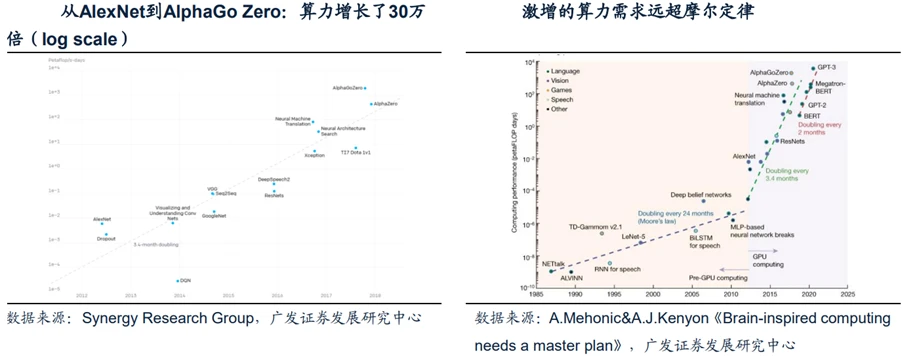

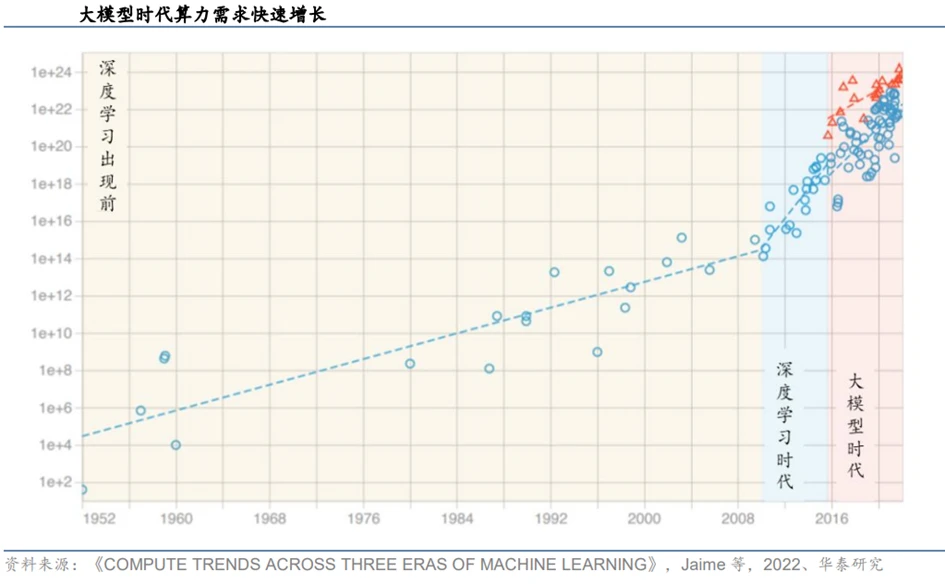

ChatGPT引发新一轮AI算力需求爆发。根据OpenAI发布的《AIand Compute》分析报告中指出,自2012年以来,AI训练应用的算力需求每3-4个月就会翻倍,从2012年至今,AI算力增长超过了30万倍。据OpenAI报告,ChatGPT的总算力消耗约为3640PF-days(即假如每秒计算一千万亿次,需要计算3640天),需要7-8个算力500P的数据中心才能支撑运行。上海新兴信息通信技术应用研究院首席专家贺仁龙表示,“自2016年阿尔法狗问世,智能算力需求开启爆发态势。如今ChatGPT则代表新一轮AI算力需求的爆发”。

全球算力规模将呈现高速增长态势。根据国家数据资源调查报告数据,2021年全球数据总产量67ZB,近三年平均增速超过26%,经中国信息通信研究院测算,2021年全球计算设备算力总规模达到615EFlops,增速达44%。根据中国信通院援引的IDC数据,2025年全球算力整体规模将达3300EFlops,2020-2025年的年均复合增长率达到50.4%。结合华为GIV预测,2030年人类将迎来YB数据时代,全球算力规模达到56ZFlops,2025-2030年复合增速达到76.2%。

4、算力需求攀升下,GPU行业市场巨大

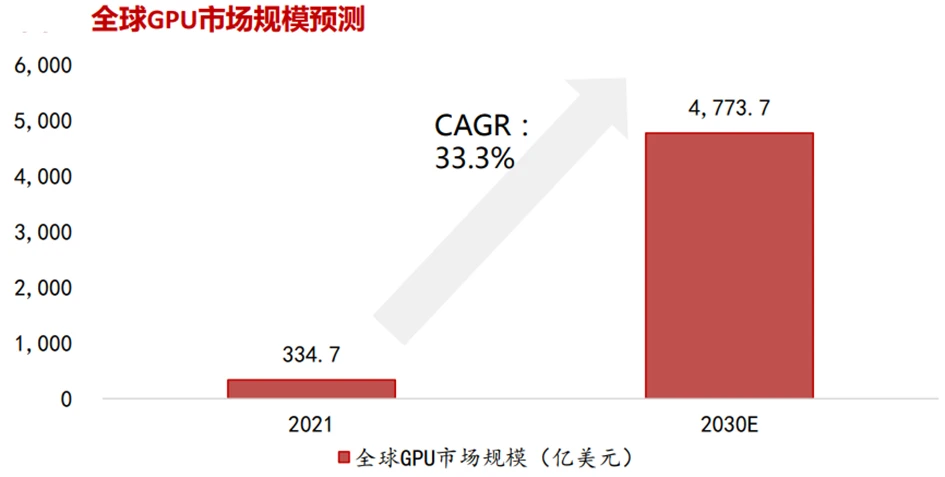

AIGC模型硬件以GPGPU为主,GPU市场规模有望在2030年超过4000亿美元。GPU在并行计算方面具有性能优势,在AI领域分化成两条分支:一条是传统意义的GPU,专门用于图形图像处理用途;另一条是GPGPU,作为运算协处理器,增加了专用指令来满足不同领域的计算需求。使用GPGPU在云端进行模型训练算法,能够显著缩短海量训练数据的训练时长,减少能源消耗,从而降低人工智能的应用成本,目前全球人工智能相关处理器解决方案仍以GPGPU为主。

根据Verified Market Research报告,2021年全球GPU芯片市场规模已经达到了334.7亿美元,并预计到2030年将达到4,773.7亿美元,CAGR高达33.3%。GPU市场保持着高速增长态势,其在人工智能领域中仍然是不可或缺的计算资源之一。

02

产业发展现状

1、当前大模型的实现,需要强大的算力来支持训练过程和推理过程

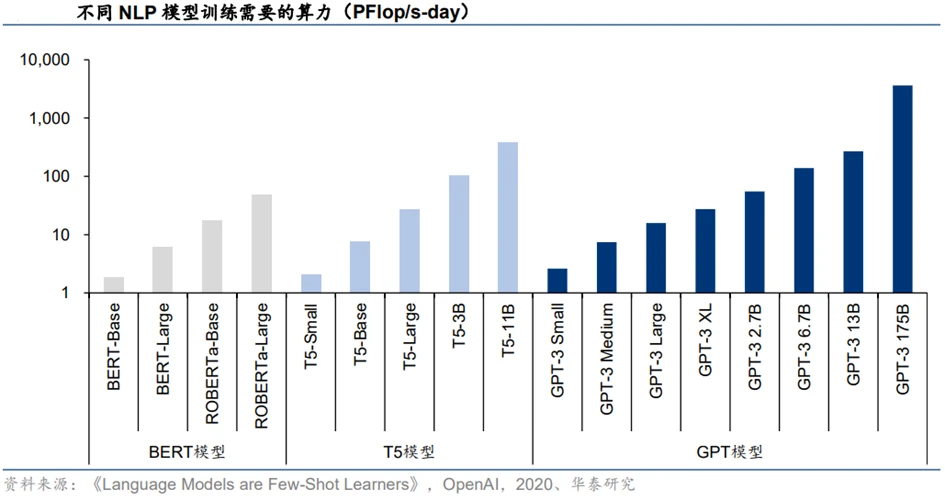

大模型的实现,需要十分强大的算力来支持训练过程和推理过程。根据OPENAI数据,训练GPT-3175B的模型,需要的算力高达3640PF-days。2018年以来,大模型的参数量级已达到数千亿参数的量级规模,对算力的需求将呈现指数级增长。

2、AI芯片性能提升,成为决定大模型从理论实践到大规模应用的关键要素

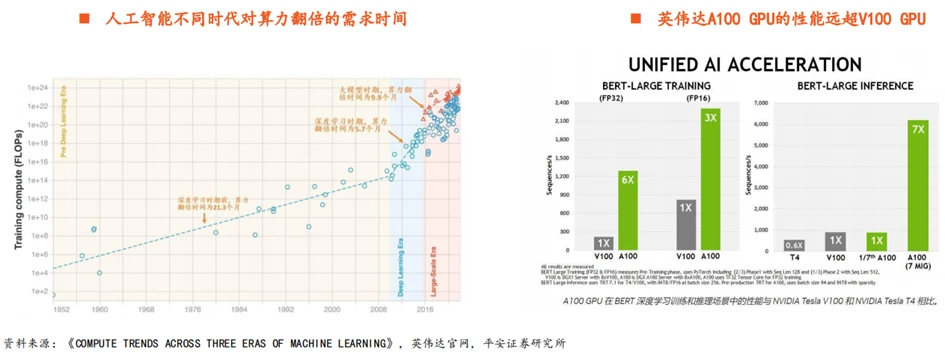

根据《COMPUTE TRENDS ACROSS THREE ERAS OF MACHINE LEARNING》研究结果,AI芯片的性能提升成为决定大模型从理论实践到大规模应用的关键要素。

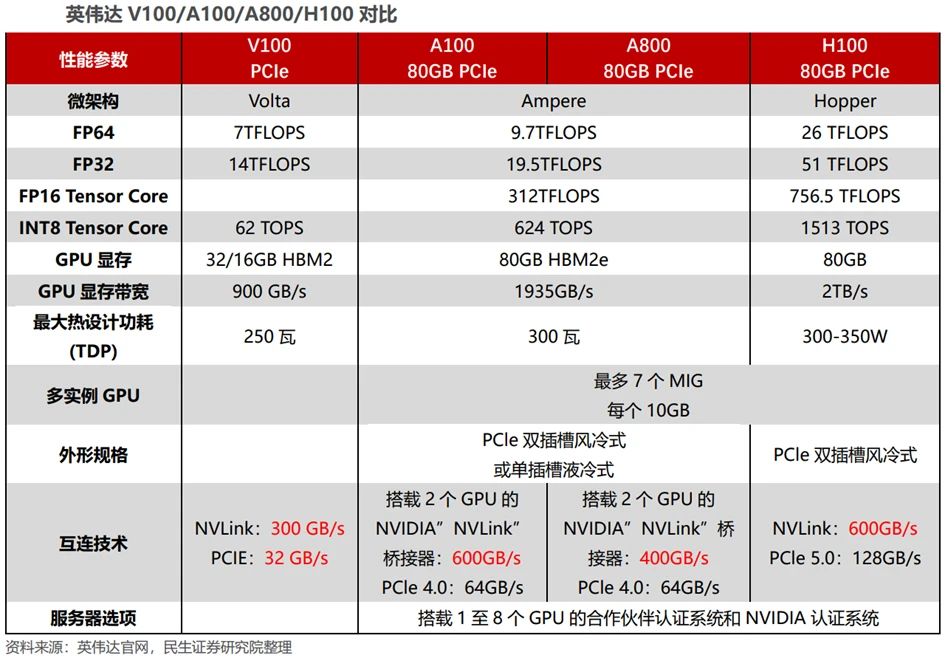

在供给端,AI芯片厂商推出了性能越来越强的新产品来应对人工智能发展的算力需求。以英伟达为例,2020年,英伟达推出了A100 GPU芯片,相比上一代V100 GPU芯片,A100 GPU芯片性能大幅提升。针对大模型,A100 GPU芯片相比V100 GPU芯片可提供高达3倍的训练速度。

3、大模型将为全球和中国AI芯片和AI服务器市场的增长,提供强劲动力

随着全球和中国人工智能厂商布局大模型,大模型将为全球和中国AI服务器市场的增长提供强劲动力。根据《2022年北京人工智能产业发展白皮书》数据,截至2022年10月,北京拥有人工智能核心企业1048家,占我国人工智能核心企业总量的29%。以此计算,我国人工智能核心企业总数约为3614家。

假设其中有2%的企业自建IDC训练和推理大模型,那么单一企业自建IDC推理和训练大模型的算力成本约为4.78(4.03+0.75)亿美元,以此估算,大模型将为我国AI服务器市场带来约345.50亿美元的市场空间。以2021年我国AI服务器市场规模占全球AI服务器市场规模的占比估算,则将为全球AI服务器市场带来约910.44亿美元的市场空间。市场空间巨大,相关芯片和服务器厂商将深度受益此次ChatGPT浪潮。

03

供需格局分析

1、需求端:大算力消耗带来训练成本上升,算力霸权时代或将到来

大算力消耗带来训练成本上升,训练ChatGPT需要使用大量算力资源。据微软官网,微软Azure为OpenAI开发的超级计算机是一个单一系统,具有超过28.5万个CPU核心、1万个GPU和400GB/s的GPU服务器网络传输带宽。据英伟达,使用单个Tesla架构的V100 GPU对1746亿参数的GPT-3模型进行一次训练,需要用288年时间。此外,算力资源的大量消耗,必然伴随着算力成本的上升,据Lambda,使用训练一次1746亿参数的GPT-3模型,所需花费的算力成本超过460万美元。虽然GPT-3.5在模型参数量上有了明显下降,但考虑到GPT-3、GPT-3.5均为OpenAI独家拥有,其他厂商复刻难度较高,巨量参数或仍将是模型开发过程的必经之路,我们预计未来大模型开发的算力成本仍将较高。

模型算力需求增速超越芯片性能增速,算力霸权时代或将到来。据OpenAI测算,自2012年以来,全球头部AI模型训练算力需求3-4个月翻一番,每年头部训练模型所需算力增长幅度高达10倍。而摩尔定律认为,芯片计算性能大约每18-24个月翻一番。因此,AI训练模型算力需求增长与芯片计算性能增长之间的不匹配,或将带来对算力基础设施供给需求的快速增长。考虑到算力对于AI模型训练效果的关键性作用,拥有更丰富算力资源的模型开发者,或将能够训练出更优秀的AI模型,算力霸权时代或将开启。

具体来看,AI大模型对于算力资源的需求主要体现在以下三类场景:

(1)模型预训练带来的算力需求

模型预训练过程是消耗算力的最主要场景。ChatGPT采用预训练语言模型,核心思想是在利用标注数据之前,先利用无标注的数据,即纯文本数据训练模型,从而使模型能够学到一些潜在的跟标注无关的知识,最终在具体的任务上,预训练模型就可以利用大量的无标注数据知识。在Transformer的模型架构下,语言预训练过程可以根据上下文一次处理所有输入,实现大规模并行计算。通过堆叠多个解码模块,模型的层数规模也会随着提升,可承载的参数量同步增长。与之相对应的,模型训练所需要消耗的算力也就越大。

预计训练一次ChatGPT模型需要的算力约27.5PFlop/s-day。据OpenAI团队发表于2020年的论文《Language Models are Few-Shot Learners》,训练一次13亿参数的GPT-3XL模型需要的全部算力约为27.5PFlop/s-day,训练一次1746亿参数的GPT-3模型需要的算力约为3640PFlop/s-day。考虑到ChatGPT训练所用的模型是基于13亿参数的GPT-3.5模型微调而来,参数量与GPT-3XL模型接近,因此我们预计训练所需算力约27.5PFlop/s-day,即以1万亿次每秒的速度进行计算,需要耗时27.5天。

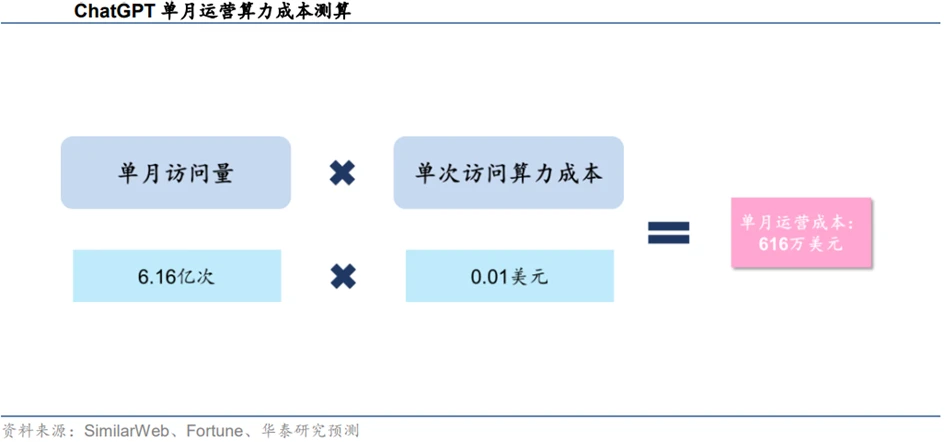

(2)日常运营带来的算力需求预计ChatGPT单月运营需要算力约4874.4PFlop/s-day,对应成本约616万美元。在完成模型预训练之后,ChatGPT对于底层算力的需求并未结束,日常运营过程中,用户交互带来的数据处理需求,同样也是一笔不小的算力开支。据SimilarWeb数据,2023年1月ChatGPT官网总访问量为6.16亿次。据Fortune杂志,每次用户与ChatGPT互动,产生的算力云服务成本约0.01美元。基于此,我们测算得2023年1月OpenAI为ChatGPT支付的运营算力成本约616万美元。据上文,我们已知训练一次1746亿参数的GPT-3模型需要3640PFlop/s-day的算力及460万美元的成本,假设单位算力成本固定,测算得ChatGPT单月运营所需算力约4874.4PFlop/s-day。

(3)Finetune带来的算力需求模型调优带来迭代算力需求。从模型迭代的角度来看,ChatGPT模型并不是静态的,而是需要不断进行Finetune模型调优,以确保模型处于最佳应用状态。这一过程中,一方面是需要开发者对模型参数进行调整,确保输出内容不是有害和失真的;另一方面,需要基于用户反馈和PPO策略,对模型进行大规模或小规模的迭代训练。因此,模型调优同样会为OpenAI带来算力成本,具体算力需求和成本金额取决于模型的迭代速度。2、供给端:核心环节有望率先受益(1)算力芯片:AI算力基石,需求有望大规模扩张GPU架构更适合进行大规模AI并行计算,需求有望大规模扩张。从ChatGPT模型计算方式来看,主要特征是采用了并行计算。对比上一代深度学习模型RNN来看,Transformer架构下,AI模型可以为输入序列中的任何字符提供上下文,因此可以一次处理所有输入,而不是一次只处理一个词,从而使得更大规模的参数计算成为可能。而从GPU的计算方式来看,由于GPU采用了数量众多的计算单元和超长的流水线,因此其架构设计较CPU而言,更适合进行大吞吐量的AI并行计算。基于此,我们认为,随着大模型训练需求逐步增长,下游厂商对于GPU先进算力及芯片数量的需求均有望提升。

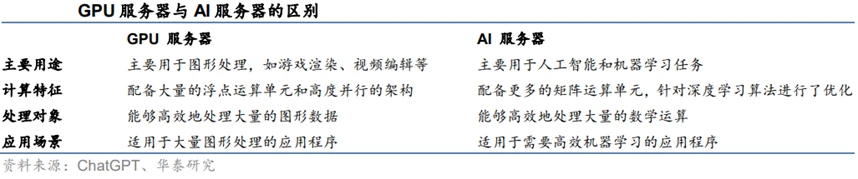

单一英伟达V100芯片进行一次ChatGPT模型训练,大约需要220天。我们以AI训练常用的GPU产品—NVIDIA V100为例。V100在设计之初,就定位于服务数据中心超大规模服务器。据英伟达官网,V100拥有640个Tensor内核,对比基于单路英特尔金牌6240的CPU服务器,可以实现24倍的性能提升。考虑到不同版本的V100芯片,在深度学习场景下计算性能存在差异,因此我们折中选择NVLink版本V100(深度学习算力125TFlops)来计算大模型训练需求。据相关测算,我们已知训练一次ChatGPT模型(13亿参数)需要的算力约27.5PFlop/s-day,计算得若由单个V100GPU进行计算,需220天;若将计算需求平均分摊至1万片GPU,一次训练所用时长则缩短至约32分钟。(2)服务器:AI服务器有望持续放量ChatGPT主要进行矩阵向量计算,AI服务器处理效率更高。从ChatGPT模型结构来看,基于Transformer架构,ChatGPT模型采用注意力机制进行文本单词权重赋值,并向前馈神经网络输出数值结果,这一过程需要进行大量向量及张量运算。而AI服务器中往往集成多个AIGPU,AIGPU通常支持多重矩阵运算,例如卷积、池化和激活函数,以加速深度学习算法的运算。因此在人工智能场景下,AI服务器往往较GPU服务器计算效率更高,具备一定应用优势。

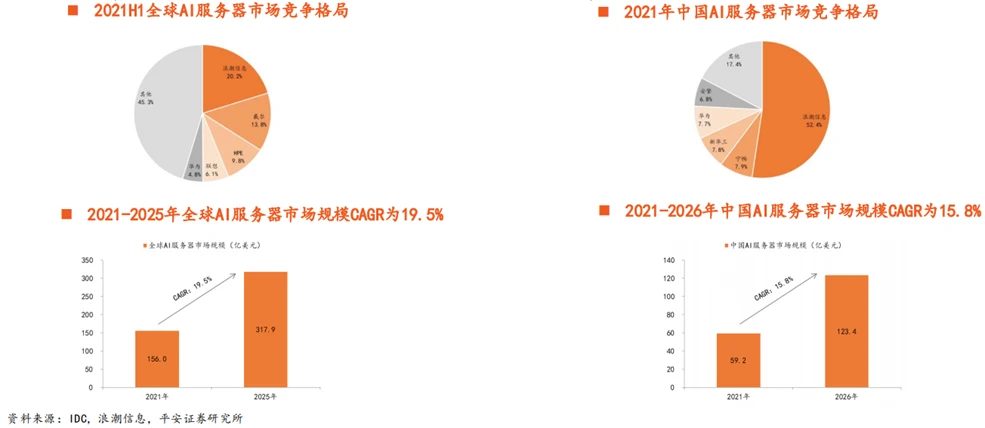

单台服务器进行一次ChatGPT模型训练所需时间约为5.5天。我们以浪潮信息目前算力最强的服务器产品之一—浪潮NF5688M6为例。NF5688M6是浪潮为超大规模数据中心研发的NVLink AI服务器,支持2颗Intel最新的Ice Lake CPU和8颗NVIDIA最新的NVSwitch全互联A800GPU,单机可提供5 PFlops的AI计算性能。我们已知训练一次ChatGPT模型(13亿参数)需要的算力约27.5PFlop/s-day,计算得若由单台NF5688M6服务器进行计算,需5.5天。大模型训练需求有望带动AI服务器放量。随着大数据及云计算的增长带来数据量的增加,对于AI智能服务器的需求明显提高。据IDC数据,2021年全球AI服务器市场规模为156亿美元,预计到2025年全球AI服务器市场将达到318亿美元,预计22-25年CAGR将达19.5%。2021年中国AI服务器行业市场规模为350.3亿元,同比增长68.6%,预计22-25年CAGR将达19.0%。我们认为,随着ChatGPT持续火热,国内厂商陆续布局ChatGPT类似产品,AI服务器采购需求有望持续增长,市场规模或将进一步扩张。(3)数据中心:核心城市集中算力缺口或将加剧IDC算力服务是承接AI计算需求的直接形式。ChatGPT的模型计算主要基于微软的Azure云服务进行,本质上是借助微软自有的IDC资源,在云端完成计算过程后,再将结果返回给OpenAI。可见,IDC是承接人工智能计算任务的重要算力基础设施之一,但并不是所有企业都需要自行搭建算力设施。从国内数据中心的业务形态来看,按照机房产权归属及建设方式的角度,可分为自建机房、租赁机房、承接大客户定制化需求以及轻资产衍生模式四种。AI训练需求有望带动IDC市场规模快速增长。据中国信通院,2021年国内IDC市场规模1500.2亿元,同比增长28.5%。随着我国各地区、各行业数字化转型深入推进、AI训练需求持续增长、智能终端实时计算需求增长,2022年国内市场规模达1900.7亿元,同增26.7%。

互联网厂商布局ChatGPT类似产品,或将加大核心城市IDC算力供给缺口。据艾瑞咨询,2021年国内IDC行业下游客户占比中,互联网厂商居首位,占比为60%;其次为金融业,占比为20%;政府机关占比10%,位列第三。而目前国内布局ChatGPT类似模型的企业,同样以互联网厂商为主,如百度宣布旗下大模型产品“文心一言”将于2022年3月内测、京东于2023年2月10日宣布推出产业版ChatGPT:ChatJD。另一方面,国内互联网厂商大多聚集在北京、上海、深圳、杭州等国内核心城市,在可靠性、安全性及网络延迟等性能要求下,或将加大对本地IDC算力需求,国内核心城市IDC算力供给缺口或将加大。

04

AI服务器产业格局

AI服务器和AI芯片是算力发展中极为重要,同时也是企业争相突破的环节,其发展状况,对于整个人工智能行业的发展至关重要,以下我们就分别对AI芯片和AI服务器两部分展开分析。

1、AI服务器:人工智能发展核心算力底座,算力升级催化其加速渗透

AI服务器是采用异构形式的服务器,如CPU+GPU、CPU+TPU、CPU+其他的加速卡等。而普通的服务器是以CPU为算力的提供者,采用的是串行架构。在大数据、云计算、人工智能及物联网等网络技术的应用下,数据呈现几何倍数的增长,CPU的核心数已经接近极限,但数据还在持续增加,因此必须提升服务器的数据处理能力,AI服务器应运而生。通常AI服务器需要承担大量的计算,一般配置四块以上的GPU卡。

随着数据及运算量提升,接口传输速度要求提升,对应PCB层数将增加、介电损耗降低且单价提升,端口数量增加亦将拉动以太网物理层芯片(PHY)的用量提升,CPU、GPU供电使用的多相电源需求量大幅增加。在此基础上,由于有多个GPU卡,需对系统结构、散热、拓扑等进行设计,才能满足AI服务器长期稳定运行的要求。

随数据量提升,AI服务器加速渗透,22-26年全球服务器市场复合增速近15%。根据IDC数据,2022年全球AI相关支出1193亿美元,同比增长28.0%,其中AI硬件、AI服务、AI软件支出占比分别为20.4%、24.5%、55.1%;AI硬件支出中,服务器、存储器占比83.2%、16.8%。根据IDC数据,2022年全球AI服务器市场规模202亿美元,同比增长29.8%,占服务器市场规模的比例为16.4%,同比提升1.2pct。2022年上半年全球AI服务器市场中,浪潮、戴尔、惠普、联想、新华三分别以15.1%、14.1%、7.7%、5.6%、4.7%的市场份额位居前五位。IDC预计2026年全球AI服务器市场规模将达到355亿美元,对应22-26年CAGR为15.1%。

2、国内AI服务器呈现一超多强的市场格局

浪潮信息占据全球AI服务器市场龙头地位。根据IDC统计,中国企业在全球AI服务器市场中所占份额持续提升。其中,2021年浪潮信息市场份额约20%,龙头地位稳固;戴尔和HPE市占率分别达到13.8%、9.8%,排名分列第二、第三。

国内AI服务器市场集中度高,呈现“一超多强”的局面。根据IDC统计,2021年国内AI服务器排名前5的厂商占据了超过80%的市场份额。其中,浪潮信息的市占率遥遥领先,约52%;宁畅、华为、新华三市占率相近,略低于8%,构成第二梯队;安擎、宝德分别为6.8%、5.1%,紧随其后。

AI服务器性能要求持续提升,产品不断迭代。大规模AI计算模型,不仅仅对AI服务器的空间和算力提出了极高的要求,还在冷却技术、算力资源调度和灵活性方面,推动着高性能、高技术水平产品的诞生。国内代表性企业推出的AI服务器产品,在CPU和GPU芯片性能、功率、计算平台和扩展等关键指标上达到了较高水平,支持互联网、数据库、分布式存储和加速计算等行业多样化的应用场景。例如,浪潮信息的NF5688M6服务器是为超大规模数据中心专门研发,空间达到6U,采用GPU:计算IB:存储IB=8:8:2的高性能配比,适用于对算力要求较高的大规模的模型训练。

05

AI芯片产业格局

1、AI芯片提供算力基础,国内外市场都将保持快速增长

全球市场:全球人工智能技术发展逐渐成熟,数字化基础设施不断建设完善,推动全球人工智能芯片市场高速增长。IDC全球范围调研显示,人工智能芯片搭载率(attachrate)将持续增高。根据Tractica、寒武纪招股书相关数据,全球人工智能芯片2022年市场规模预计约395亿美金,预计到2025年将达到726亿美金,年复合增长率达到22%。

国内市场:22-24年复合增速有望达到46%。随着大数据的发展和计算能力的提升,根据寒武纪招股书,2022年中国人工智能芯片市场规模预计达368亿元,预计2024年市场规模将达到785亿元,复合增速有望达到46%。

2021年国内仍以GPU为主实现数据中心计算加速。根据IDC数据,2021年中国人工智能芯片市场中,GPU的市场占有率近90%,ASIC,FPGA,NPU等非GPU芯片市场占有率超过10%。

2、AI芯片赋能算力基石,英伟达垄断全球市场

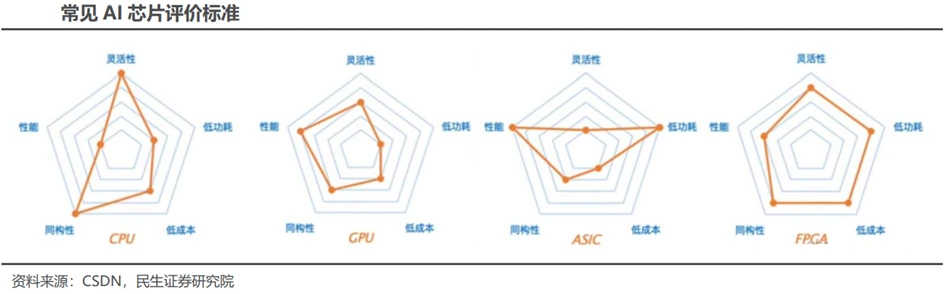

AI算力芯片主要包括GPU、FPGA,以及以VPU、TPU为代表的ASIC芯片。其中以GPU用量最大,据IDC数据,预计到2025年GPU仍将占据AI芯片8成市场份额。然而,相较传统图形GPU,通用型算力GPU在芯片架构上缩减了图形图像显示、渲染等功能实现,具有更优的计算能效比,因而被广泛应用于人工智能模型训练、推理领域。

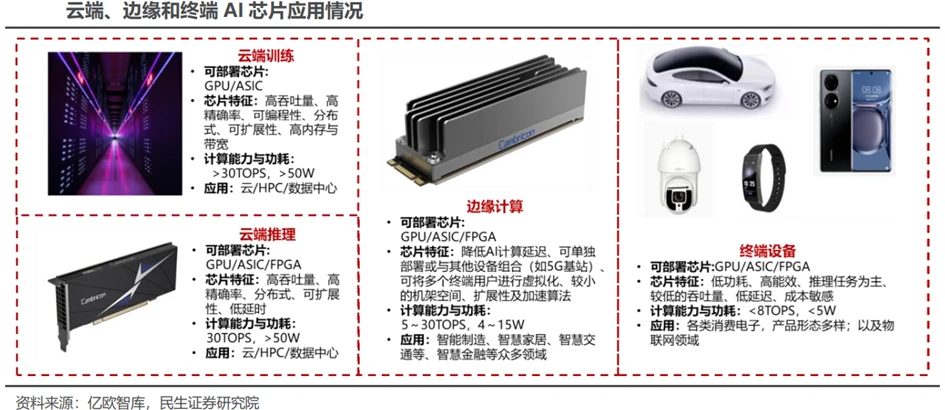

根据在网络中的位置,AI芯片可以分为云端AI芯片、边缘和终端AI芯片;根据其在实践中的目标,可分为训练(training)芯片和推理(inference)芯片。云端主要部署高算力的AI训练芯片和推理芯片,承担训练和推理任务,具体有智能数据分析、模型训练任务和部分对传输带宽要求比高的推理任务;边缘和终端主要部署推理芯片,承担推理任务,需要独立完成数据收集、环境感知、人机交互及部分推理决策控制任务。

由于英伟达GPU产品线丰富、产品性能顶尖、开发生态成熟,目前全球AI算力芯片市场仍由英伟达垄断。根据中国信通院的数据,2021年Q4英伟达占据了全球95.7%的GPU算力芯片市场份额,因此,英伟达数据中心业务营收增速可以较好地反应全球AI芯片市场增速。2023财年,英伟达数据中心营收达到150亿美元,同比增长41%,FY2017-FY2023复合增速达63%,表明全球AI芯片市场规模保持高速增长。

3、性能与生态构筑AI算力芯片高壁垒

评价AI芯片的指标主要包括算力、功耗、面积、精度、可扩展性等,其中算力、功耗、面积(PPA)是评价AI芯片性能的核心指标:

算力:衡量AI芯片算力大小的常用单位为TOPS或者TFLOS,两者分别代表芯片每秒能进行多少万亿次定点运算和浮点运算,运算数据的类型通常有整型8比特(INT8)、单精度32比特(FP32)等。AI芯片的算力越高,代表它的运算速度越快、性能越强。

功耗:功耗即芯片运行所需的功率,除了功耗本身,性能功耗比是综合衡量芯片算力和功耗的关键指标,它代表每瓦功耗对应输出算力的大小。

面积:芯片的面积是成本的决定性因素之一,通常来讲相同工艺制程之下,芯片面积越小良率越高,芯片成本越低。此外,单位芯片面积能提供的算力大小,亦是衡量AI芯片成本的关键指标之一。

除PPA之外,运行在AI芯片上的算法输出精度、AI应用部署的可扩展性与灵活性,均为衡量AI芯片性能的指标。

英伟达的GPGPU是全球应用最为广泛的AI芯片,决定其性能的硬件参数主要包括:微架构、制程、CUDA核数、Tensor核数、频率、显存容量、显存带宽等。其中,微架构即GPU的硬件电路设计构造的方式,不同的微架构决定了GPU的不同性能,作为英伟达GPU的典型代表,V100、A100、H100 GPU分别采用Volta、Ampere、Hopper架构;CUDA核是GPU内部主要的计算单元;Tensor核是进行张量核加速、卷积和递归神经网络加速的计算单元;显存容量和带宽是决定GPU与存储器数据交互速度的重要指标。

除GPU硬件之外,与之配套的软件开发体系亦是生态的重要组成部分。GPU的生态包括底层硬件、指令集架构、编译器、API、基础库、顶层算法框架和模型等,英伟达于2006年发布的CUDA平台是当今全球应用最为广泛的AI开发生态系统。通用GPU与CUDA组成的软硬件底座构成了英伟达引领AI计算的根基,当前全球主流深度学习框架均使用CUDA平台。

生态构建计算壁垒,国产GPU厂商初期兼容CUDA,长期仍需构筑自身软硬件生态。由于当前全球主流深度学习框架均使用CUDA平台进行开发,国产GPU可以通过兼容CUDA的部分功能,快速打开市场,减少开发难度和用户移植成本。然而,CUDA本身涵盖功能非常广泛,且许多功能与英伟达GPU硬件深度耦合,包含了许多英伟达GPU的专有特性,这些特性并不能在国产AI芯片上全部体现。因此,长期来看国产GPU厂商仍需通过提升自身的软硬件实力,构筑属于自己的软硬件生态。

4、国产AI算力芯片正起星星之火

全球AI芯片市场被英伟达垄断,然而国产AI算力芯片正起星星之火。目前,国内已涌现出了如寒武纪、海光信息等优质的AI算力芯片上市公司,非上市AI算力芯片公司如沐曦、天数智芯、壁仞科技等亦在产品端有持续突破。

5、自主可控受高度重视,国产AI算力芯片迎“芯“机遇

加快实现高水平科技自立自强,是推动高质量发展的必由之路。结合前期数字中国建设规划落地、浪潮集团被美国商务部列入”实体清单“等事件,我们认为,国产AI算力芯片迎来发展“芯“机遇,自主可控亟待加速。

自主可控受高度重视,高水平科技亟需自立自强。国家相关部门在“两会”期间组建国家数据局,负责统筹推进数字经济发展、推进数据基础设施布局建设等任务,有望加速推进数字中国建设落地;重组科技部,并组建中央科技委员会,亦有望加速推动国内高水平科技实现自立自强。AI算力芯片作为数字中国的算力基础,国产突破势在必行,国产AI算力芯片迎来发展”芯“机遇。

数字中国建设对AI芯片国产化提出新要求。在2月27日印发的《数字中国建设整体布局规划》中,提出要夯实数字基础设施和数据资源体系“两大基础”,我们认为,数字中国基础设施的建设有望拉动以数据中心、超算中心、智能计算中心为代表的算力基础设施建设,从而带动服务器与AI算力芯片的需求快速增长。同时,《规划》提出要构筑自立自强的数字技术创新体系,上游AI芯片作为算力基础,自主可控需求凸显,数字中国建设对AI芯片国产化提出新要求。

浪潮集团被列入“实体清单“,AI芯片国产化进程有望加速。当地时间3月2日,美国商务部将浪潮集团、龙芯中科等37个实体列入“实体清单“,扩大对浪潮等中国企业的出口禁令。浪潮集团等公司被列入“实体清单”,再度敲响了中国AI产业发展的警钟,我们不但要加大数字基础设施建设,AI算力芯片的自主可控推进也势在必行。

06

产业链及相关企业

1、产业链概况

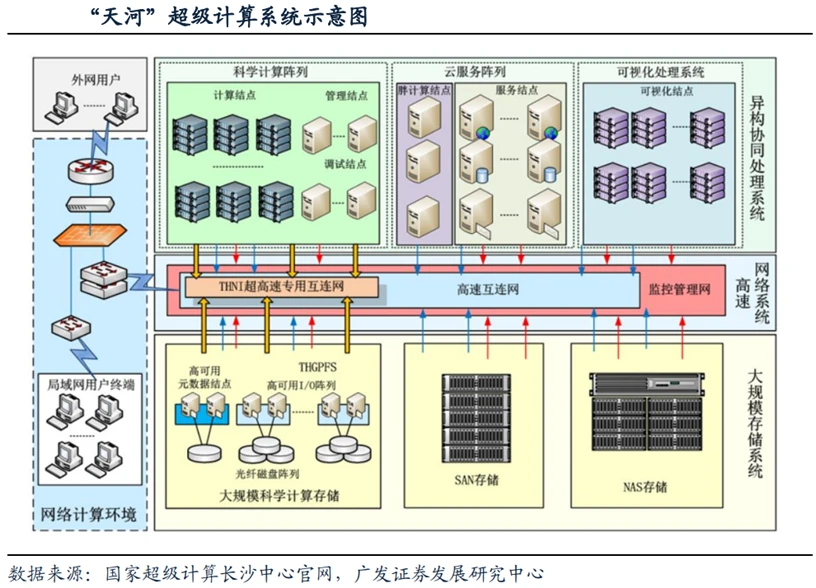

目前,我国算力产业链已经初步形成,涵盖由设施、设备、软件供应商、网络运营商构成的上游产业,由基础电信企业、第三方数据中心服务商、云计算厂商构成的中游产业,由互联网企业、工业企业以及政府、金融、电力等各行业用户构成的下游产业。

当前,算力产业主要包含云计算、IDC、人工智能等细分产业;通信产业主要包括基站、接入网和核心网等细分产业。

随着信息通信技术从云网融合向算网一体迈进,算力和网络产业的边界日益模糊,形成以“算+网+协同”为主线的算力网络产业格局,上游为底层硬件基础设施,中游为算力网络相关平台、服务及关键技术,下游为赋能的应用场景及最终用户,产业链关键环节如下图所示。

2、相关分析当前,我国算力供给水平大幅提升,先进计算创新成果涌现。算力产业加速壮大升级,我国已经形成体系较完整、规模体量庞大、创新活跃的计算产业,在全球产业分工体系中的重要性日益提升。我国计算产业规模约占电子信息制造业的20%,规模以上企业达2300余家。整个产业链来看,运营商涉及算力网络产业链上、中、下游多个环节,已在网络领域拥有不可复制的业务优势,因此站在运营商视角,算力网络建设的核心在于“泛在高品质的算力”和“灵活强协同的调度”。海量数据集中化处理、分布化计算需求爆发式增长,数据中心和边缘计算行业是实现泛在高品质算力的关键;算网业务的实现需要算力和网络以一体化形态对外提供服务,具备智能化编排管理能力的算网大脑是支撑灵活强协同调度的核心。我国算力赋能效应不断激发,智改数转进入纵深发展。算力深度融入互联网、电信、金融、制造等下游行业,为各行业各领域的智能化改造和数字化转型提供支撑。算力助推信息消费持续扩大升级,虚拟现实与元宇宙有望成为推动算力下一个增长阶段的驱动力。数字经济时代,算力不仅是关键生产力,也将成为普遍应用。随着算力基础设施建设的推进,算力应用的新模式、新业态正加速涌现,算力深度融入制造、交通、教育、航空航天、金融、传媒等更多行业,同时,算力调度、算力管理、算力交易也成为业界探索的重点。2022年3月,工业和信息化部正式公布首批国家新型数据中心典型案例名单,共有32个大型以上数据中心和12个边缘数据中心入选。3、重点公司梳理(1)戴尔:全球服务器龙头,提供完整AI架构与方案戴尔以生产、设计、销售家用以及办公室电脑而闻名,生产与销售服务器、数据储存设备、网络设备等。2016年9月,EMC Corporation和戴尔公司合并,新公司将被命名为戴尔科技(Dell Technologies)。新公司营业重点将转向云服务,并推进服务器及存储领域整合。戴尔科技集团可以提供完整的AI基础架构、AI平台就绪解决方案和AI行业应用。AI基础架构包括高性能AI训练服务器、AI推理服务器、AI边缘计算、高性能AI存储系统PowerScale、DPS数据保护解决方案和数据中心网络。AI平台就绪解决方案则包括基于CPU、IPU、GPU的AI就绪解决方案,GPU分布式训练自动化实现,Graphcore IPUAI专用芯片,NVAIE,GPU虚拟化,AIaaS平台和OMNIA开源社区。

(2)浪潮:AI服务器市占率稳居榜首浪潮信息是全球领先的新型IT基础架构产品、方案及服务提供商。公司是全球领先的AI基础设施供应商,拥有业内最全的人工智能计算全堆栈解决方案,涉及训练、推理、边缘等全栈AI场景,构建起领先的AI算法模型、AI框架优化、AI开发管理和应用优化等全栈AI能力,为智慧时代提供坚实的基础设施支撑。生产算力方面,公司拥有业内最强最全的AI计算产品阵列,业界性能最好的Transformer训练服务器NF5488、全球首个AI开放加速计算系统MX1、自研AI大模型计算框架LMS。聚合算力层面,公司针对高并发训练推理集群进行架构优化,构建了高性能的NVMe存储池,深度优化了软件栈,性能提升3.5倍以上。调度算力层面,浪潮信息AIstation计算资源平台可支持AI训练和推理,是业界功能最全的AI管理平台;同时,浪潮信息还有自动机器学习平台AutoML Suite,可实现自动建模,加速产业化应用。

(3)中科曙光:我国高性能计算、智能计算领军企业中科曙光作为我国核心信息基础设施领军企业,在高端计算、存储、安全、数据中心等领域拥有深厚的技术积淀和领先的市场份额,并充分发挥高端计算优势,布局智能计算、云计算、大数据等领域的技术研发,打造计算产业生态,为科研探索创新、行业信息化建设、产业转型升级、数字经济发展提供了坚实可信的支撑。依托先进计算领域的先发优势和技术细节,中科曙光全面布局智能计算,完成了包括AI核心组件、人工智能服务器、人工智能管理平台、软件等多项创新,构建了完整的AI计算服务体系。并积极响应时代需求,在智能计算中心建设浪潮下,形成了5A级智能计算中心整体方案。目前,曙光5A智能计算中心已在广东、安徽、浙江等地建成,江苏、湖北、湖南等地已进入建设阶段,其他地区也在紧张筹备和规划中。

(4)海光信息:支持全精度,GPU实现规模量产海光信息主要从事高端处理器、加速器等计算芯片产品和系统的研究、开发,主要产品包括海光CPU和海光DCU。2018年10月,公司启动深算一号DCU产品设计,海光8100采用先进的FinFET工艺,典型应用场景下性能指标可以达到国际同类型高端产品的同期水平。2020年1月,公司启动DCU深算二号的产品研发。海光DCU性能强大。海光DCU基于大规模并行计算微结构进行设计,不但具备强大的双精度浮点计算能力,同时在单精度、半精度、整型计算方面表现同样优异,是一款计算性能强大、能效比较高的通用协处理器。海光DCU集成片上高带宽内存芯片,可以在大规模数据计算过程中提供优异的数据处理能力。

(5)华为海思:五大系列发挥产业集成优势海思是全球领先的Fabless半导体与器件设计公司。前身为华为集成电路设计中心,1991年启动集成电路设计及研发业务,为汇聚行业人才、发挥产业集成优势,2004年注册成立实体公司,提供海思芯片对外销售及服务。海思致力于为智慧城市、智慧家庭、智慧出行等多场景智能终端打造性能领先、安全可靠的半导体基石,服务于千行百业客户及开发者。海思产品覆盖智慧视觉、智慧IoT、智慧媒体、智慧出行、显示交互、手机终端、数据中心及光收发器等多个领域。海思半导体旗下的芯片共有五大系列,分别是用于智能设备的麒麟Kirin系列;用于数据中心的鲲鹏Kunpeng系列服务CPU;用于人工智能的场景AI芯片组昇腾Ascend系列SoC;用于连接芯片(基站芯片Tiangang、终端芯片巴龙Balong);以及其他专用芯片(视频监控、机顶盒芯片、智能电视、运动相机、物联网等芯片)。

(6)寒武纪:少数全面掌握AI芯片技术的企业之一寒武纪主营业务是应用于各类云服务器、边缘计算设备、终端设备中人工智能核心芯片的研发和销售。公司的主要产品包括终端智能处理器IP、云端智能芯片及加速卡、边缘智能芯片及加速卡以及与上述产品配套的基础系统软件平台。寒武纪是目前国际上少数几家全面系统掌握了通用型智能芯片及其基础系统软件研发和产品化核心技术的企业之一,能提供云边端一体、软硬件协同、训练推理融合、具备统一生态的系列化智能芯片产品和平台化基础系统软件。2022年3月,寒武纪正式发布了新款训练加速卡“MLU370-X8”,搭载双芯片四芯粒封装的思元370,集成寒武纪MLU-Link多芯互联技术,主要面向AI训练任务。

07

细分受益环节

GPT-4多模态大模型将引领新一轮AI算力需求的爆发,超大规模数据中心及超算数据中心作为泛AI领域的重要基础设施支持,其数量、规模都将相应增长,带动整个算力基础设施产业链(如高端服务器/交换机、CPO技术、硅光、液冷技术)的渗透加速。同时在应用侧,Copilot的推出也将加速AI在办公领域的赋能,给相关细分环节带来发展机会。以下我们具体分析依托AI算力发展带来的细分受益环节。

1、服务器/交换机

算力需求带动上游硬件设备市场规模持续增长,高规格产品占比提升。伴随着数据流量持续提升,交换机作为数据中心必要设备,预计全球数据中心交换机保持稳定增长。2021年全球数据中心交换机市场规模为138亿美元,预计到2031年将达246亿美元,2022年至2031年复合年增长率为5.9%。多元开放的AI服务器架构可以为人工智能发展提供更高的性能和可扩展性的AI算力支撑,随着AI应用的发展,高性能服务器数量有望随之增长,带动出货量及服务器单价相应提升。根据IDC报告,2022Q3,200/400GbE交换机市场收入环比增长25.2%,100GbE交换机收入同比增长19.8%,高速部分呈现快速增长。

2、光模块/光芯片

算力需求提升推动算力基础设施升级迭代,传统可插拔光模块技术弊端和瓶颈开始显现。首先,功耗过高,AI技术的加速落地,使得数据中心面临更大的算力和网络流量压力,交换机、光模块等网络设备升级的同时,功耗增长过快。以博通交换机芯片为例,2010年到2022年交换机芯片速率从640G提升到51.2T,光模块速率从10G迭代到800G。速率提升的同时,交换机芯片功耗提升了约8倍,光模块功耗提升了26倍,SerDes功耗提升了25倍。其次,交换机端口密度难以继续提升,光模块速率提升的同时,自身体积也在增大,而交换机光模块端口数量有限。另外,PCB材料也遭遇瓶颈,PCB用于传输高速电信号,传统可插拔光模块信号传输距离长、传输损失大,更低耗损的可量产PCB材料面临技术难题难以攻克。

NPO/CPO技术有望成为高算力背景下的解决方案。CPO(光电共封装技术)是一种新型的高密度光组件技术,将交换芯片和光引擎共同装配在同一个Socketed(插槽)上,形成芯片和模组的共封装。CPO可以取代传统的插拔式光模块技术,将硅光电组件与电子晶片封装相结合,从而使引擎尽量靠近ASIC,降低SerDes的驱动功耗成本,减少高速电通道损耗和阻抗不连续性,实现更高密度的高速端口,提升带宽密度,大幅减少功耗。CPO技术的特点主要有:CPO技术缩短了交换芯片和光引擎之间的距离(控制在5~7cm),使得高速电信号在两者之间实现高质量传输,满足系统的误码率(BER)要求;CPO用光纤配线架取代更大体积的可插拔模块,系统集成度得到提升,实现更高密度的高速端口,提升整机的带宽密度;降低功耗,根据锐捷网络招股说明书,采用CPO技术的设备整机相比于采用可插拔光模块技术的设备,整机功耗降低23%。

高算力背景下,数据中心网络架构升级带动光模块用量扩张及向更高速率迭代。硅光、相干及光电共封装技术(CPO)等具备高成本效益、高能效、低能耗的特点,被认为是高算力背景下的解决方案。CPO将硅光电组件与电子晶片封装相结合,使引擎尽量靠近ASIC,减少高速电通道损耗,实现远距离传送。目前,头部网络设备和芯片厂商已开始布局硅光、CPO相关技术与产品。

3、数据中心

IDC数据中心:“东数西算”工程正式全面启动一周年,从系统布局进入全面建设阶段。随着全国一体化算力网络国家枢纽节点的部署和“东数西算”工程的推进,算力集聚效应初步显现,算力向规模化集约化方向加速升级,同时数据中心集中东部的局面得到改善,西部地区对东部地区数据计算需求的支撑作用越发明显。我们认为政策面推动供给侧不断出清,AI等应用将带动新一轮流量需求,有望打破数据中心近两年供给过剩的局面,带动数据中心长期发展。

液冷温控:随云计算、AI、超算等应用发展,数据中心机柜平均功率密度数预计将逐年提升,高密度服务器也将被更广泛的应用于数据中心中。数据中心液冷技术能够稳定CPU温度,保障CPU在一定范围内进行超频工作不会出现过热故障,有效提升了服务器的使用效率和稳定性,有助于提高数据中心单位空间的服务器密度,大幅提升数据中心运算效率,液冷技术有望在超高算力密度场景下持续渗透。

4、企业通信

3月16日晚微软正式宣布推出Microsoft 365 Copilot,将大型语言模型(LLMs)的能力嵌入到Office办公套件产品中。基于GPT-4的Copilot以其视频+图文的多模态分析以及更强大生成与理解能力,可更深度、全面发挥视频会议AI助理功能,比如可以确定目标捕捉发言总结某人谈话要点、全面理解会议主要内容,并自动整理及发送会议纪要等。随着Copilot更强大功能对微软办公套件的加持,有望带动Teams需求的增长,中国企业通信终端厂商将作为微软重要的硬件合作伙伴有望深度受益。

08

产业发展前瞻

1、基础设施支持层面:云商/运营商积极推进AI领域算力基础设施建设

北美云厂商资本支出向技术基础设施和新数据中心架构倾斜。22Q4亚马逊资本支出主要用于技术基础设施的投资,其中大部分用于支持AWS业务增长与支持履行网络的额外能力。预计未来相关投资将延续,并增加在技术基础设施方面的支出。谷歌指引2023年资本开支与2022年基本持平,其中技术基础设施有所增加,而办公基础设施将减少。Meta2022年资本开支为314.3亿美元,同比增长69.3%,但同时Meta略微调低其2023年资本开支预期至300-330亿美元(此前预期为340-370亿美元),主要原因系减少数据中心建设的相关支出,转向新的更具成本效益的、同时支持AI和非AI工作量的数据中心新架构。

国内三大运营商积极布局算力网络,资本支出向新兴业务倾斜。电信运营商作为数字基座打造者,运营商数字业务板块成为收入增长的主要引擎,近几年资本支出由主干网络向新兴业务倾斜。中国移动2022年全年算力网络投资480亿元,占其总资本开支的39.0%。2022Q3,中国移动算力规模达到7.3EFLOPS,并计划在2025年底达到20EFLOPS以上。中国电信产业数字化资本开支占比同比上升9.3pc,算力总规模计划由2022年中的3.1EFLOPS提升至2025年底的16.3EFLOPS。中国联通2022年预估算力网络资本开支达到145亿,同比提升43%。

作为算力基础设施建设的主力军,三大运营商目前已经进行前瞻性的基础设施布局。通信运营商自身拥有优质网络、算力、云服务能力,同时具备天然的产业链优势,依靠5G+AI技术优势,为下游客户提供AI服务能力,是新型信息服务体系中重要的一环,助力千行百业数字化转型。在移动网络方面,中国运营商已建设覆盖全国的高性能高可靠4/5G网络;在固定宽带方面,光纤接入(FTTH/O)端口达到10.25亿个,占比提升至95.7%;在算力网络方面,运营商在资本开支结构上向算力网络倾斜,提升服务全国算力网络能力。在AI服务能力方面,加快AI领域商业化应用推出,发挥自身产业链优势,助力千行百业数字化转型。

2、技术发展层面:算力需求带动数据中心架构及技术加速升级

(1)数据中心呈现超大规模发展趋势

超大规模数据中心,即Hyperscale Data Center,与传统数据中心的核心区别在于超大规模数据中心具备更强大的可扩展性及计算能力。规模上,超级数据中心可容纳的规模要比传统数据中心大得多,可以容纳数百万台服务器和更多的虚拟机;性能上,超级数据中心具有更高的可扩展性和计算能力,能够满足数据处理数量和速率大幅提升的需求。

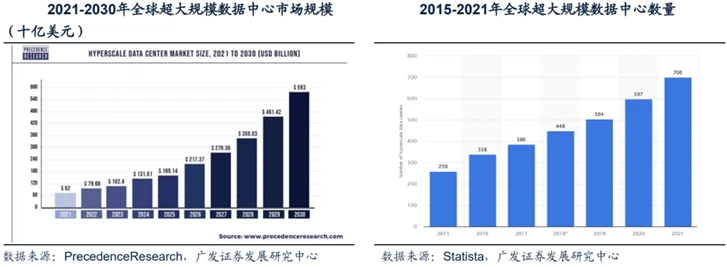

Statista数据显示,全球超大规模数据中心的数量从2015年的259个,提升到2021年的700个。根据Precedence Research的报告显示,全球超大规模数据中心市场规模在2021年为620亿美元,到2030年将达到5930亿美元,预计在2022-2030年间以28.52%的复合增长率(CAGR)增长。

海内外云商均具备自己的超大规模数据中心。Structure Research在其报告中测算,到2022年全球超大规模自建数据中心总容量达到13177兆瓦(MW)。全球四大超大规模数据中心平台——AWS、谷歌云、Meta和微软Azure——约占该容量的78%。全球占主导地位的超大规模数据中心企业仍然是亚马逊、谷歌、Meta和微软,在中国,本土企业阿里巴巴、华为、百度、腾讯和金山云都是领先的超大规模数据中心企业。

(2)IB网络技术将更广泛应用于AI训练超算领域

超级数据中心是具有更大规模和更高计算能力的数据中心。随着对数据处理数量和速率需求的提升,数据中心的可扩展性需求也在迅速提升。超级数据中心在规模和性能上较传统数据中心都有了大幅升级,能够满足超高速度扩展,以满足超级需求的能力。

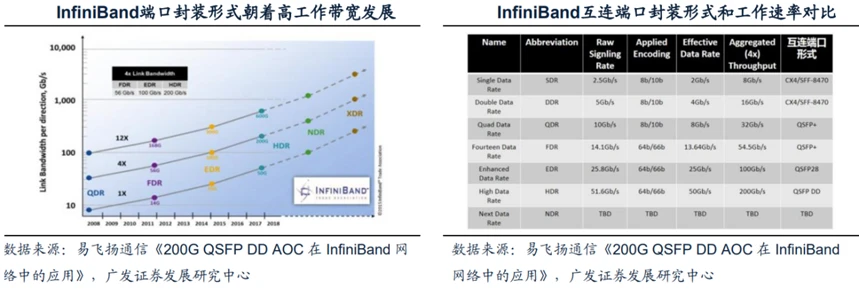

InfiniBand网络满足大带宽和低时延的需求,成为超算中心的主流。InfiniBand(简称IB)是一个用于高性能计算的计算机网络通信标准,主要应用于大型或超大型数据中心。IB网络的主要目标是实现高的可靠性、可用性、可扩展性及高性能,且能在单个或多个互联网络中支持冗余的I/O通道,因此能够保持数据中心在局部故障时仍能运转。相比传统的以太网络,带宽及时延都有非常明显的优势。(一般InfiniBand的网卡收发时延在600ns,而以太网上的收发时延在10us左右,英伟达推出的MetroX-3提升长距离InfiniBand系统带宽至400G)。作为未来算力的基本单元,高性能的数据中心越来越多的采用InfiniBand网络方案,尤其在超算中心应用最为广泛,成为AI训练网络的主流。

3、政策环境层面:工业和信息化部持续推进算力产业工作

持续推动算力基础设施建设。统筹布局绿色智能的算力基础设施,推进一体化大数据中心体系建设,加速打造数网协同、数云协同、云边协同、绿色智能的多层次算力设施体系,实现算力水平的持续显著提升,夯实数字经济发展“算力底座”。

聚力推进核心关键技术攻关。充分发挥我国的体制优势和市场优势,提升自主创新能力,加快高端芯片、新型数据中心、超算等领域研发突破,加强先进计算、算网融合等技术布局,推动算力产业向高效、绿色方向发展。

不断激发算力“引擎”赋能效应。深入挖掘算力在数字政府、工业互联网、车联网、金融科技等创新应用场景下的融合应用,提高算力在医疗、交通、教育等传统行业的应用水平,加快推进算力在更多生产生活场景的应用落地。

原文链接:https://www.bilibili.com/read/cv23033027/

评论 ( 0 )