原创 罗湖检察 深圳市罗湖区人民检察院

“你有没有想过换个面孔,体验不同的生活?”

如今随着科技发展进步,AI换脸技术让想象变为现实。有趣的AI换脸风靡一时,但一些不法分子也趁虚而入,开始利用该项技术设计新型骗局。这不,连当红明星黄晓明都深陷此类骗局之中……

近期黄晓明在节目中坦言,看到了一段自己和刘亦菲为某品牌代言的视频,自己在活动现场极力推荐该品牌。而他本人对此竟然毫不知情,印象中从未担任过该品牌代言人,一时间感到恍惚,难辨真假。原来该视频是AI换脸生成的,包括人声也可以合成。这样的换脸技术连本人都差点被骗,更何况是看视频的观众呢?

最近AI换脸成为一种新型电信诈骗手段,形式层出不穷:直播间的主播换脸成明星艺人,瞬间就能增加流量、助力带货;人贩子利用AI换脸伪装成小朋友的父母,仅一次视频通话就能赢得小朋友的信任……只需一台高配置的电脑,以及一两分钟,一段10秒的换脸视频就自动生成。伴随AI换脸的滥用,涉及的犯罪行为也越来越多:诈骗、拐卖、敲诈勒索、侵犯肖像权……

01

AI换脸新型诈骗

数秒骗取上百万元

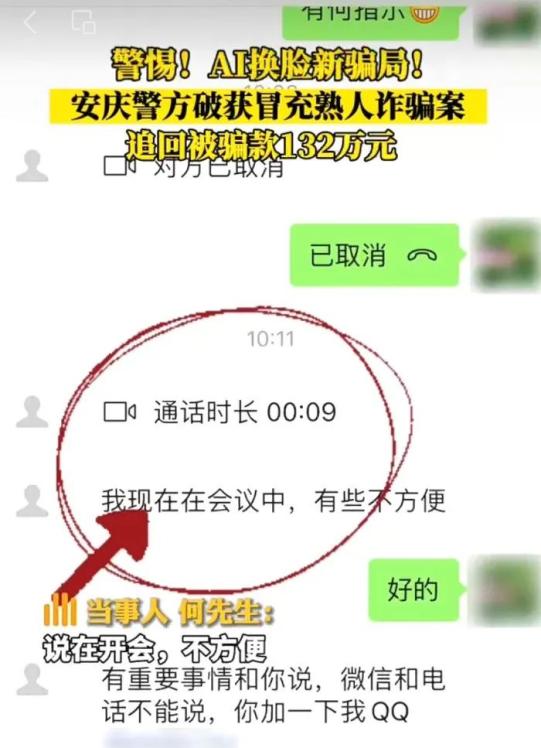

今年5月,安徽的何先生接到一个熟人的视频电话,声称目前有一个项目招标需要周转资金,希望何先生能够先行帮忙垫付。但9秒之后,对方以正在开会为由,迅速挂断了视频。

“因为打了视频电话又是熟人,我没多想就转账了”,基于对“熟人”的信任,何先生没有犹豫,立刻让家人将245万元汇到对方指定的账号上,直到事后再次拨打对方电话才得知被骗。幸运的是,发现被骗之后,何先生迅速报警,专案民警第一时间冻结相关账户,连夜赶赴北京市抓获了3名涉诈嫌疑人,追回何先生被骗的132万元。

无独有偶,今年4月,福建的郭先生在10分钟内被AI换脸骗走430万元。这天郭先生的好友突然通过微信视频联系他,称自己的朋友在外地竞标,需要430万元保证金,想借用郭先生公司的账户走账。

“当时是给我打了视频的,我在视频中也确认了面孔和声音,所以才放松了戒备。”基于对好友的信任,加上已经视频聊天“核实”了身份,郭先生在10分钟内,先后分两笔把430万元转到了对方的银行账户上。

02

AI技术不是法外之地

需明确AI换脸的法律边界

虽然换脸技术如此以假乱真、防不胜防,但面对此类新型诈骗方式我们并不是束手无策,AI技术终归要受到法律的约束。

对于构成诈骗罪的,要依照我国刑法第二百六十六条的规定追究刑事责任;对于为AI换脸实施诈骗行为提供技术支持、帮助的,要根据《中华人民共和国反电信网络诈骗法》的规定进行行政处罚,构成犯罪的,还要根据《中华人民共和国刑法》第二百八十七条之二规定的帮助信息网络犯罪活动罪追究刑事责任。

国家也在通过多种手段,防范AI换脸诈骗。

近两年先后出台了《互联网信息服务深度合成管理规定》《生成式人工智能服务管理暂行办法》等有关政策文件,对人脸生成、替换、操控、合成人声等都有明确的约束。

10月13日,国家金融监督管理总局发布《关于警惕利用AI新型技术实施诈骗的风险提示》提醒广大消费者警惕新型诈骗手段,维护个人及家庭财产安全。

网络技术飞速发展,如今“眼见不一定为实”。

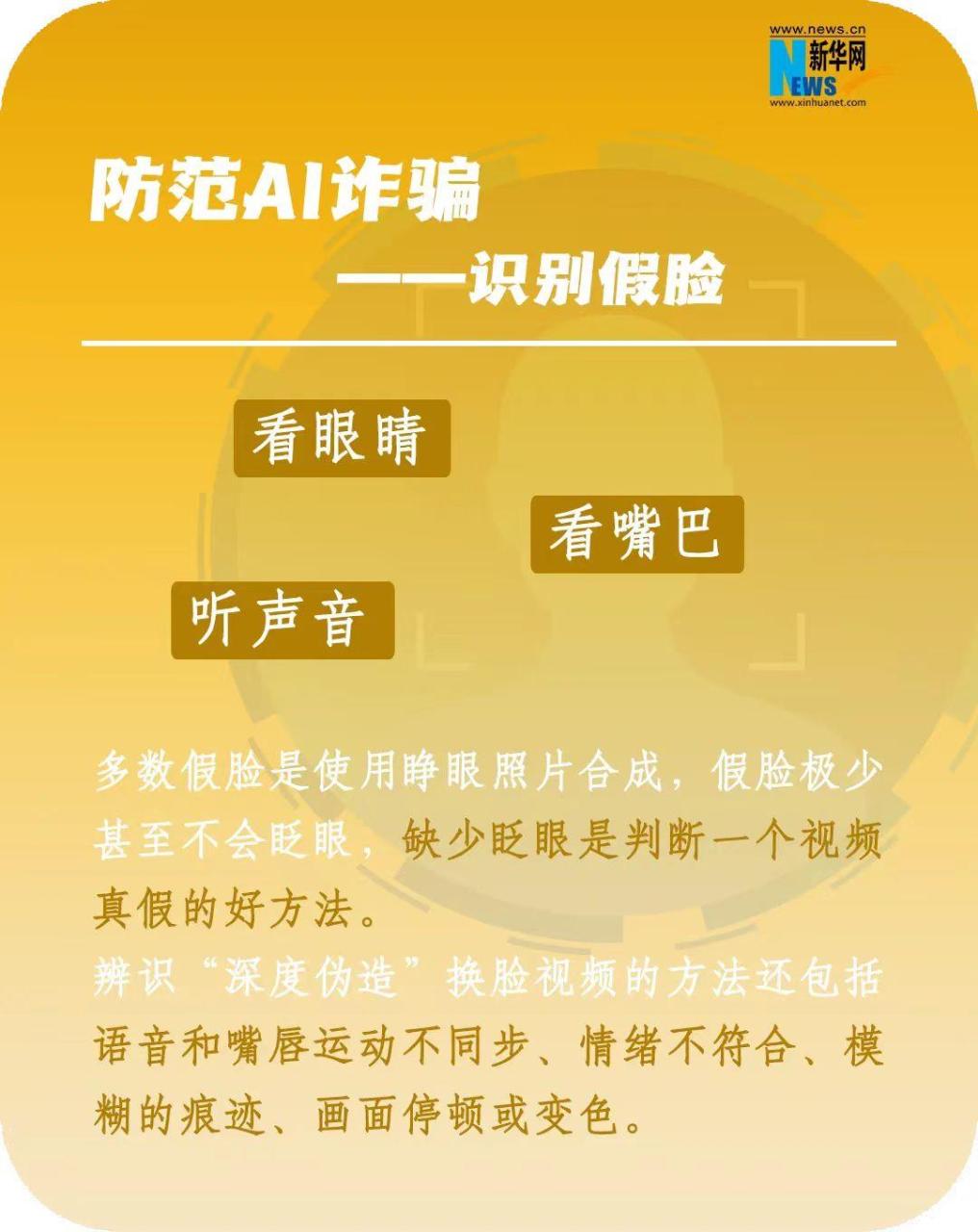

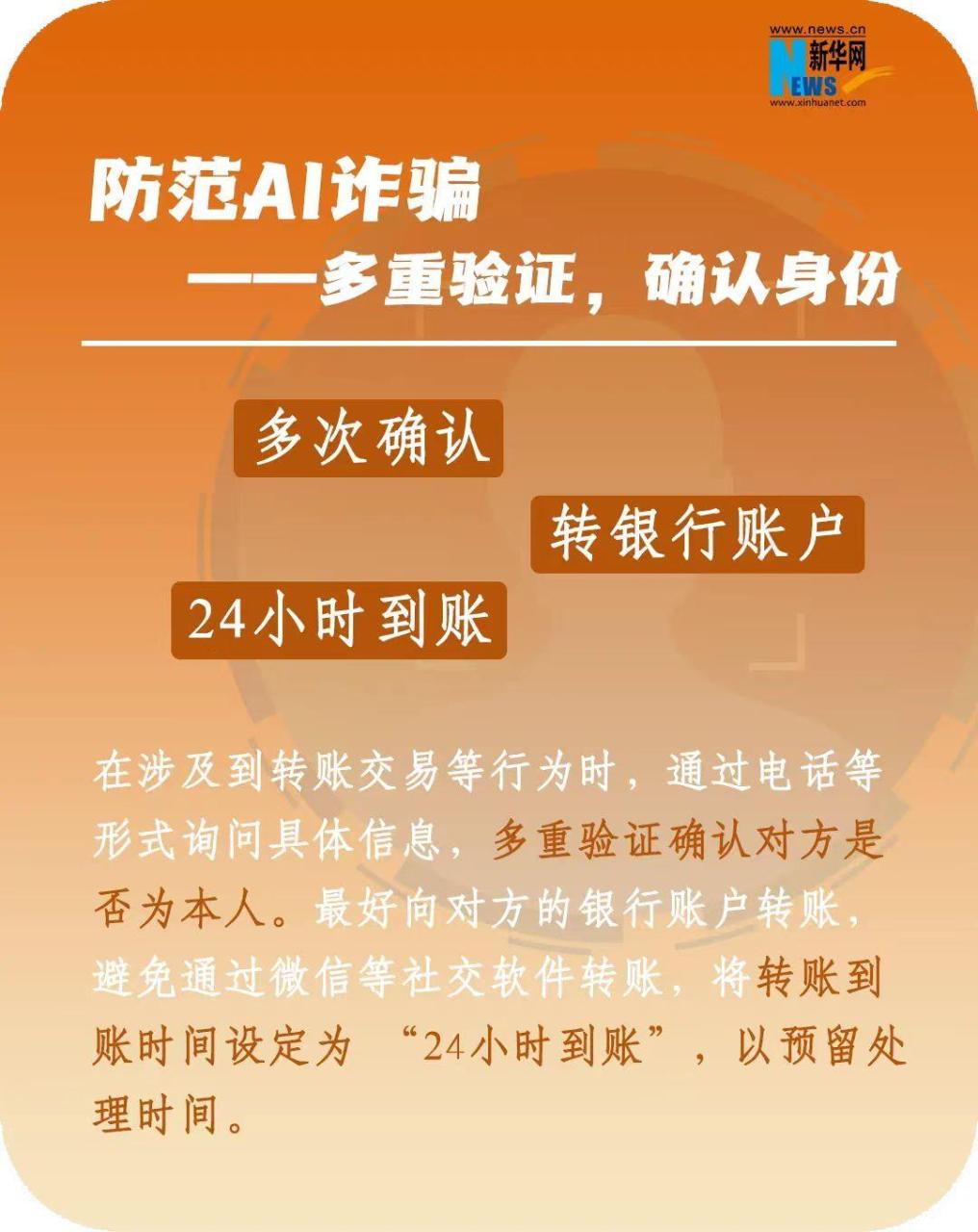

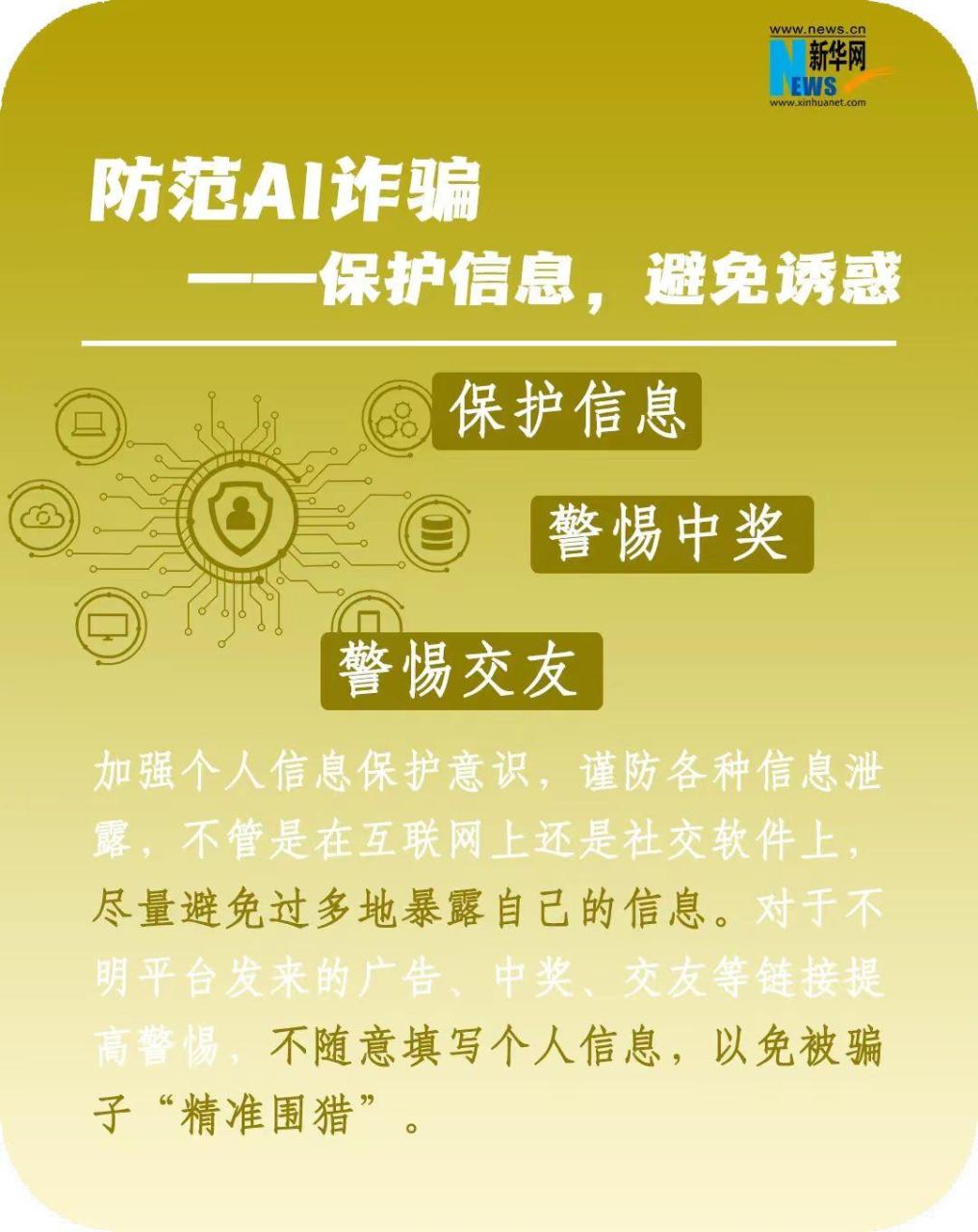

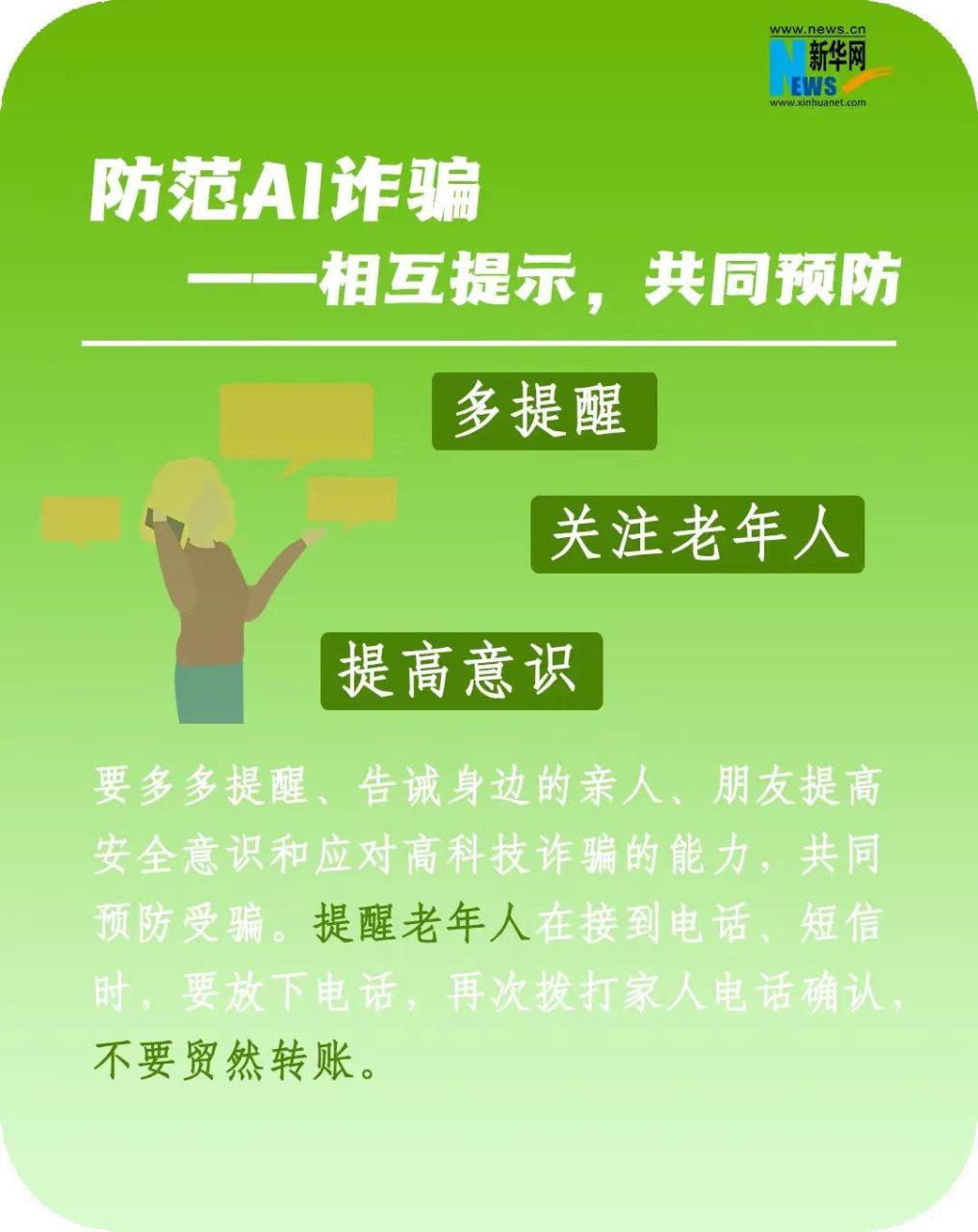

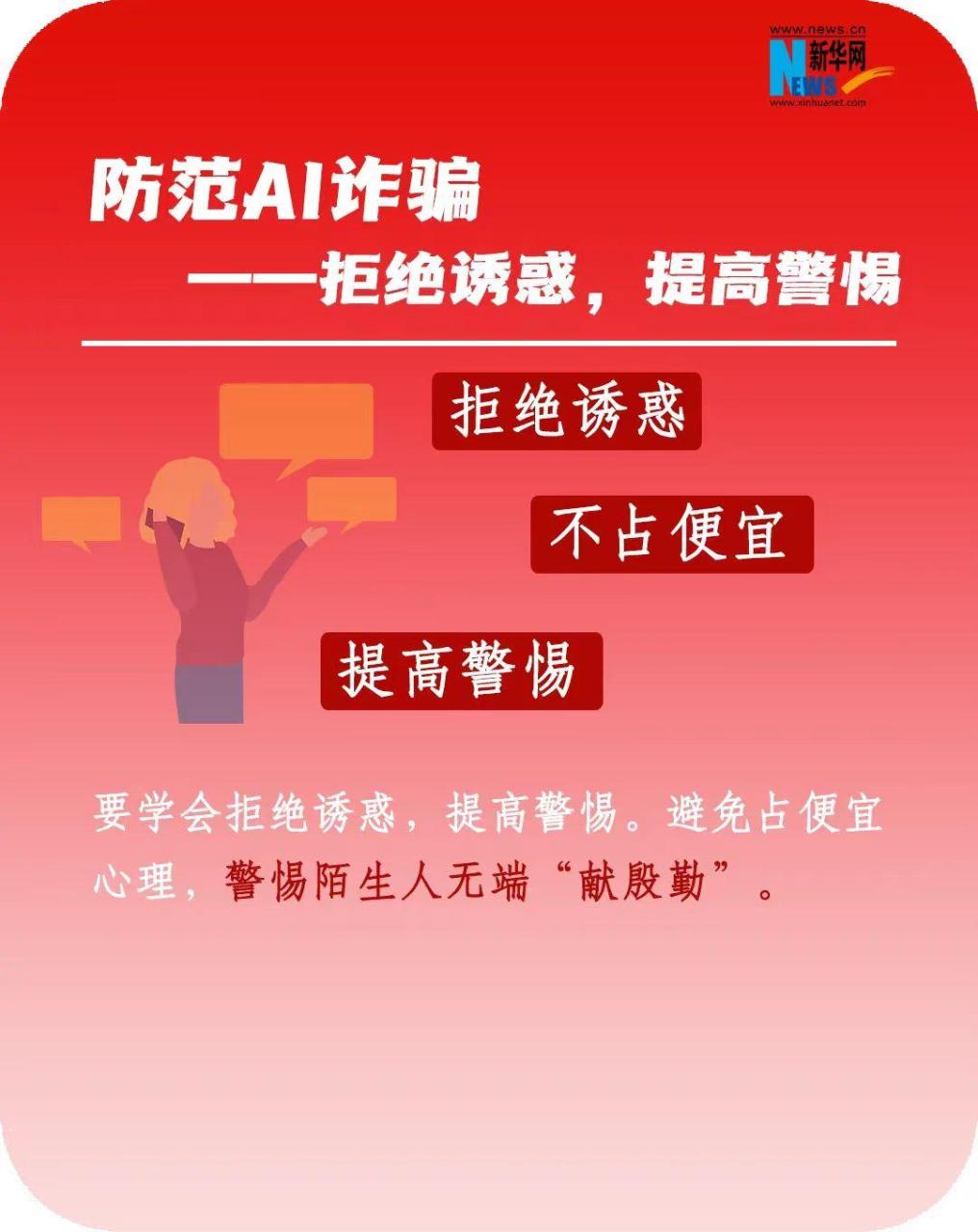

信息网络时代要学会保护个人身份信息和生物信息、增强反诈意识、提高辨别能力。涉及网络转账交易行为时,务必通过回拨视频通话、线下见面、向对方家人验证等多种途径核验对方身份,不要未经核实随意转账汇款,以下的防骗小妙招一定要牢记:

如不慎被骗或遇到可疑情形,切记注意保存相关的聊天、转账记录等证据,并立即报警。让我们共同努力,保护个人信息和财产安全,共建安全、可信的数字社会!

信息来源:办公室 许嘉馨

(注:本微信中部分图片来源于网络,版权归原作者所有。如有任何涉及版权方面的问题,请及时与我们联系,我们将妥善处理!)

原标题:《警惕!AI换脸!黄晓明都被骗?检察官提醒如何识别…》

原文链接:https://m.thepaper.cn/baijiahao_25229257

评论 ( 0 )