韩国首尔2021年8月24日 /美通社/ — 近期,三星在Hot Chips 33会议上展示了其在内存内处理(PIM)技术方面的最新进展。Hot Chips 33会议作为半导体行业的重要会议,每年都会有备受瞩目的微处理器和IC创新产品亮相。

三星发布的信息包括,三星首次成功将基于PIM的高带宽存储器(HBM-PIM)整合到商用化加速器系统中,并扩大PIM应用范围至DRAM模组和移动内存,从而加速实现内存和逻辑的融合。

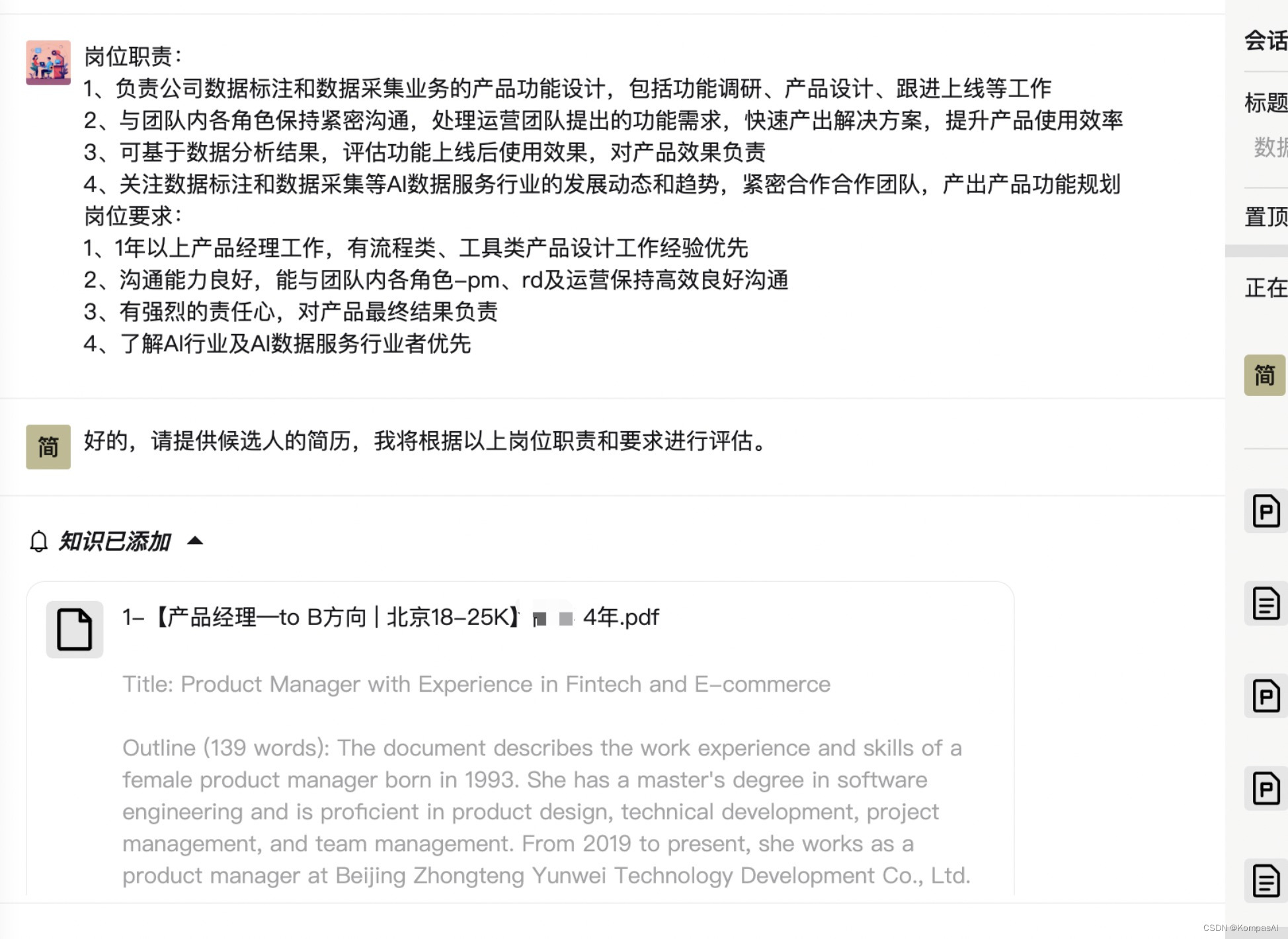

三星首次将HBM-PIM集成到AI加速器中

今年2月,三星推出了其首个HBM-PIM(Aquabolt-XL),将AI处理能力整合到三星HBM2 Aquabolt中,以增强超级计算机和AI应用的高速数据处理能力。随后,HBM-PIM在赛灵思(Xilinx)Virtex Ultrascale+(Alveo)AI加速器中进行了测试,它提升了近2.5倍的系统性能,并降低超过60%的能耗。

“HBM-PIM是三星首个在客户AI加速器系统中进行了测试的AI定制内存解决方案,显示出巨大的商业潜力。”三星电子DRAM产品和技术高级副总裁Nam Sung Kim表示,“随着技术标准化发展,该技术应用将会进一步扩大,扩展至用于下一代超级计算机和AI应用的HBM3,甚至用于设备上AI的移动存储器,以及用于数据中心的存储器模块。”

“赛灵思一直与三星电子合作,从Virtex UltraScale+ HBM系列开始,为数据中心、网络和实时信号处理应用提供高性能解决方案。近期,双方又推出了令人振奋的Versal HBM系列产品。”赛灵思产品规划部高级总监Arun Varadarajan Rajagopal表示,“很高兴能与三星继续开展合作,我们帮助评估HBM-PIM系统在AI应用中实现重大性能,及能效提升的潜力。”

由PIM驱动的DRAM模块

加速DIMM(AXDIMM)能在DRAM模块内进行“处理”,尽可能减少CPU和DRAM之间的大量数据交换,以提升AI加速器系统的能源效率。由于缓冲芯片内嵌有AI引擎,AXDIMM可对多个内存排列(DRAM芯片组)并行处理,而非每次仅访问一组,从而大大提升了系统性能和效率。由于AXDIMM模块能保留传统DIMM的外形尺寸,因此它能在不修改系统的情况下直接替换。目前,AXDIMM正在客户的服务器上进行测试,能够在基于AI的推荐应用中,提供大约2倍的性能,并使整个系统的能耗减少40%。

“思爱普(SAP)一直为SAP-HANA在内存内数据库(IMDB)应用方面与三星开展合作。”思爱普HANA核心研究与创新主管Oliver Rebholz表示,“根据性能预测和潜在的整合方案,我们预计内存内数据库管理(IMDBMS)的性能会有明显改善,并通过AXDIMM上的分解计算,实现更高能效。思爱普希望继续与三星在该领域进行合作。”

移动存储器将AI从数据中心带到设备上

三星LPDDR5-PIM移动存储器,可在不连接数据中心的情况下,提供独立的AI功能。模拟测试表明,LPDDR5-PIM在用于语音识别、翻译和聊天机器人等应用时,可提升1倍以上的性能,同时减少60%以上的能耗。

激发生态系统活力

三星计划通过与其他行业领导者合作,在2022年上半年实现PIM平台标准化,从而扩展AI内存产品组合。三星还将继续努力,培养一个高度健全的PIM生态系统,以确保整个内存市场的广泛适用性。

*实际性能可能因设备和用户环境而异

*本文中的产品图片以及型号、数据、功能、性能、规格参数、特点和其他产品信息(包括但不限于产品的优势、组件、性能、可用性和能力)等仅供参考,三星有可能对上述内容进行改进,且均无需通知或不受约束即可变更,具体信息请参照产品实物、产品说明书。除非经特殊说明,本文中所涉及的数据均为三星内部测试结果,本文中涉及的对比均为与三星产品相比较。

原文链接:https://www.prnasia.com/story/330105-1.shtml

评论 ( 0 )