从小众到主流,HBM内存为何能成为AI芯片最佳“搭档”?

TrendForce集邦咨询指出,为提升整体AI服务器的系统运算效能,以及存储器传输带宽等,NVIDIA、AMD、Intel等高端AI芯片中大多选择搭载HBM。目前NVIDIA的A100及H100,各搭载达80GB的HBM2e及HBM3,在其最新整合CPU及GPU的Grace Hopper芯片中,单颗芯片HBM搭载容量再提升20%,达96GB。另外,AMD的MI300也搭配HBM3,其中,MI300A容量与前一代相同为128GB,更高端MI300X则达192GB,提升了50%。同时预期Google将于2023年下半年积极扩大与Broadcom合作开发AISC AI加速芯片TPU亦采搭载HBM存储器,以扩建AI基础设施。

TrendForce集邦咨询预估,2023年市场上主要搭载HBM的AI加速芯片(如NVIDIA的H100及A100、AMD的MI200及MI300及Google的TPU等),搭载HBM总容量将达2.9亿GB,成长率近6成,2024年将持续成长3成以上。

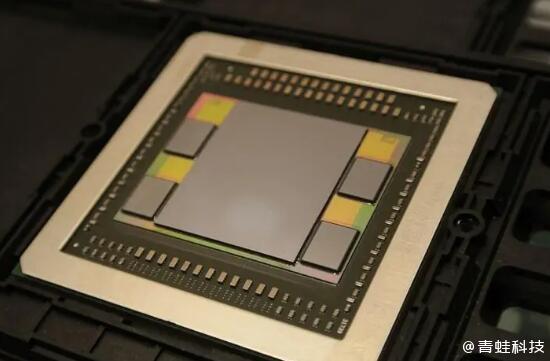

此外,AI及HPC等芯片对先进封装技术的需求日益提升,其中,以TSMC的CoWoS为目前AI 服务器芯片主力采用者。CoWoS封装技术主要分为CoW和oS两段,其中,CoW主要整合各种Logic IC(如CPU、GPU、AISC等)及HBM存储器等,另外,oS部分则将上述CoW以凸块(Solder Bump)等接合,封装在基板上,最后再整合到PCBA,成为服务器主机板的主要运算单元,与其他零部件如网络、储存、电源供应单元(PSU)及其他I/O等组成完整的AI 服务器系统。

TrendForce集邦咨询观察,估计在高端AI芯片及HBM强烈需求下,TSMC于2023年底CoWoS月产能有望达12K,其中,NVIDIA在A100及H100等相关AI Server需求带动下,对CoWoS产能较年初需求量,估提升近5成,加上AMD、Google等高端AI芯片需求成长下,将使下半年CoWoS产能较为紧迫,而此强劲需求将延续至2024年,预估若在相关设备齐备下,先进封装产能将再成长3-4成。

ChatGPT爆红提升HBM需求

作为一款自然语言类AI应用,ChatGPT不仅对芯片算力有着巨大需求,对内存技术的需求也极高,比如ChatGPT上线应用以来,拥有高速数据传输速度的HBM内存芯片几乎成为ChatGPT的必备配置,市场需求激增。有消息称,2023年开年以来三星、SK海力士HBM订单就快速增加,价格也水涨船高。

有市场人士透露英伟达已经将SK海力士的HBM3安装到其高性能GPU H100上,而H100已开始供应ChatGPT服务器所需。近期最新一代高带宽内存HBM3的价格上涨了5倍。

SK海力士HBM设计团队项目负责人朴明宰撰文介绍,HBM是一种可以实现高带宽的高附加值DRAM产品,适用于超级计算机、AI加速器等对性能要求较高的计算系统。随着计算技术的发展,机器学习的应用日渐广泛,而机器学习的基础是自20世纪80年代以来一直作为研究热点的神经网络模型。作为速度最快的DRAM产品,HBM在克服计算技术的局限性方面发挥着关键的作用。

此前,尽管HBM具有出色的性能,但与一般DRAM相比,其应用较少。这是因为HBM需要复杂的生产过程,平均售价至少是DRAM的三倍。但AI服务的扩展正在扭转这样的局面。据悉,目前已经有超过25000块英伟达计算卡加入到了深度学习的训练中。未来,随着不断接入ChatGPT等生成式AI需求大增,HBM的需求也将呈现出暴增的态势。三星内存副总裁Kim Jae-joon便指出,ChatGPT等基于自然语言技术的交互式AI应用的发展有利于提升内存需求。高效且大量的运算能力、高容量的内存,是AI学习与推论模型的根基。

存储巨头齐争高性能市场

去年以来,受消费电子产品需求下滑等多种因素影响,存储行业进入了下行周期。SK海力士全年的净利润降至2.4万亿韩元,同比下滑75%。三星电子存储业务的营收与营业利润,在去年第三季度和第四季度也是同比环比双双下滑。TrendForce集邦咨询预估2023年第一季度DRAM价格仍将持续下探。其中,PC及服务器用DRAM跌幅仍是近两成。HBM的需求火爆不啻于一剂“强心针”。这种情况下,SK海力士、三星电子、美光等内存厂商均表示将致力于HBM的开发。企业之间的产品开发竞争也随之升温。

2013年SK海力士将TSV技术应用于DRAM,在业界首次成功研发出第一代HBM芯片。此后,SK海力士相继推出HBM2、HBM2E、HBM3数代产品。据悉,SK海力士正在研发HBM4,预计新一代产品将能够更广泛地应用于高性能数据中心、超级计算机和AI等领域。SK海力士CFO金祐贤表示,公司正关注着市场上出现以AI为基础的新服务器替换存储器需求的积极信号。公司计划持续投资DDR5/LPDDR5、HBM3等主力产品的量产和未来高成长领域。

三星电子虽然在HBM的开发上落后一步,但也在寻找新的突破口。据悉,三星电子正在开发集成AI处理器新一代存内计算芯片HBM-PIM。北京大学信息科学技术学院微纳电子学系副教授叶乐表示,存内计算芯片是将AI引擎引入存储库,将处理操作转移到HBM本身,将有效加大数据传输带宽,提高内存的处理速度。存内计算技术正在实现产品化。目前基于SRAM的存内计算,已经进入到产品化的前夜,DRAM存内计算适用于大算力AI芯片,因此还需要解决其他一系列的技术难题。

HBM国产替代成大趋势

HBM的作用类似于数据的“中转站”,就是将使用的每一帧,每一幅图像等图像数据保存到帧缓存区中,等待GPU调用。因此,与传统内存技术相比,HBM具有更高带宽、更多I/O数量、更低功耗、更小尺寸,能够让AI服务器在数据处理量和传输速率有大幅提升。

当下,随着ChatGPT的AI大模型问世,百度、阿里、科大讯飞、商汤、华为等科技巨头纷纷要训练自己的AI大模型,AI服务器的需求大幅度激增。

由于短时间内处理大量数据 ,AIAI服务器对带宽提出了更高的要求,HBM则成为AI服务器的标配。随着高端GPU需求的逐步提升,TrendForce集邦咨询预估2023年HBM需求量将年增58%,2024年有望再成长约30%。可见,HBM凭借AI的爆发,也跟着站上了风口。

目前,HBM的市场被三分天下。SK海力士、三星、海光的市占率分别为50%、40%、10%。虽然,HBM的市场基本被海外巨头所占据;但是,芯片储存的自主可控仍是当下产业发展的重要方向。因此,HBM国产化也将成为大的发展趋势。这里我们根据公开信息,将HBM的相关公司整理如下:

国芯科技:目前正在研究规划合封多HBM内存的2.5D的芯片封装技术,积极推进Chiplet技术的研发和应用。

通富微电:公司2.5D/3D生产线建成后,将实现国内在HBM(高带宽内存)高性能封装技术领域的突破。

佰维存储:已推出高性能内存芯片和内存模组,将保持对HBM技术的持续关注。

澜起科技:PCIe 5.0/CXL 2.0 Retimer芯片实现量产,该芯片是澜起科技PCIe 4.0 Retimer产品的关键升级,可为业界提供稳定可靠的高带宽、低延迟PCIe 5.0/ CXL 2.0互连解决方案。

原文链接:https://www.seccw.com/Document/detail/id/21716.html

评论 ( 0 )