本文选自《GPT-4核心技术分析报告》的第2章的简写版(无公式版)。前两节从GPT家族的发展历史开始,讲解GPT-4的多模态架构和GPT-4中的关键技术。

作者陈巍博士为AI/存算一体专家,曾担任华为系自然语言处理企业的首席科学家。

技术科普与解读:ChatGPT 大模型硬核解读!(一)家族历史从GPT-1到ChatGPT

技术科普与解读:ChatGPT 大模型硬核解读!(二)GPT4 的多模态涌现能力-接近人类关键特征

“好的多模态模型一直是许多大型技术实验室的圣杯。”

作为“圣杯”的代表之一,GPT-4这个标签代表第4代生成式预训练变换模型(Generative Pre-trained Transformer 4),是OpenAI在2023年3月14日公开的一种多模态模型,是对前几个月发布的ChatGPT的多模态升级。

多模态指的是融合文本、图像、视频或音频等多种模态作为输入或输出。

GPT-4模型可对图文多模态输入生成应答文字,以及对视觉元素的分类、分析和隐含语义提取,并表现出优秀的应答能力。

GPT-4的多模态架构

1. 多模态对于大语言模型的重要意义

到了GPT-4,技术内涵产生的飞跃其实超过了ChatGPT。有些人认为GPT-4仅仅是GPT-3.5的升级优化,这其实是一种误解。大部分人可能还未看到GPT-4带来的巨大影响和未来。

人类或其他高等生物的认知能力通常与从多种模式中学习有关。例如,苹果这一概念包括从视觉和语言获得的多重语义。包括苹果的颜色、形状、纹理以及吃苹果的声音,苹果在词典或其他网络媒体的相应定义等等。我们大多数人在学习认字的时候,也是先看到苹果的卡片图像,然后再记住对应的文字。

不同模态(来源:Jonathan Reed)

与BERT模型类似,GPT-4之前的ChatGPT或GPT-3.5都是根据输入语句,根据语言/语料概率来自动生成回答的每一个字(词语)。从数学或从机器学习的角度来看,语言模型是对词语序列的概率相关性分布的建模,即利用已经说过的语句(语句可以视为数学中的向量)作为输入条件,预测下一个时刻不同语句甚至语言集合出现的概率分布。 “苹果”在GPT-3.5和之前的GPT中只是单纯的语义符号和概率。

GPT-4等模型新出现的多模态输入的能力对语言模型至关重要,使得“苹果”等单纯的符号语义扩展为更多的内涵。第一,多模态感知使语言模型能够获得文本描述之外的常识性知识。第二,多模态感知与语义理解的结合为新型任务提供了可能性,例如机器人交互技术和多媒体文档处理等等,仅列出的这两项应用就市场巨大。第三,通过多模态感知统一了接口。图形界面其实是最自然和高效的人机自然交互方式。多模态大语言模型可通过图形方式直接进行信息交互,提升交互效率和模式融合。

多模态模型可以从多种来源和模式中学习知识,并使用模态的交叉关联来完成任务。通过图像或图文知识库学习的信息可用于回答各类多模态语言问题;从文本中学到的信息也可在视觉任务中使用。

2. GPT-4多模态架构与交叉注意力

截至 2023 年初,多模态大模型正经历将图文信息进行对齐,进行模态认知管理,进一步形成多模态决策或生成的极端。常见的多模态大模型可分为:

1)图像描述生成或文本生成图像。例如最近知名的CLIP、Stable Diffusion。

2)图文问答。例如带有图示的物理题求解或图表分析。GPT-4就是典型代表。

3)文本到图像或图像到文本的检索。

4)视频流描述。

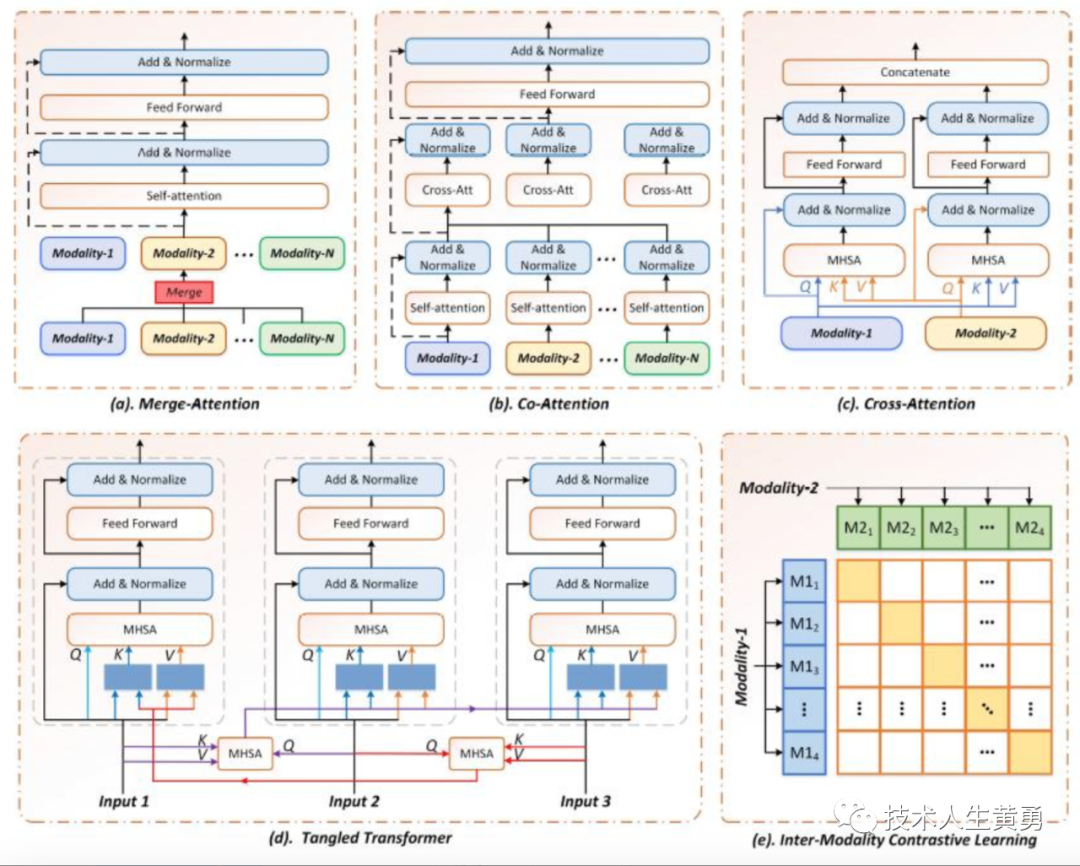

多模态模型的5种典型结构(来源:深圳鹏城实验室)

以视觉-语言模态模型为例,通常由 3 个关键元素组成:图像编码器、文本编码器以及融合来自两个编码器的信息的策略。这些关键元素紧密耦合在一起

根据鹏城实验室新发出的论文归纳,目前常见的多模态模型架构主要包括以下几种:

1)合并注意力架构(Merge-attention):如上图(a),多个输入模态调整为同一的特征表示,多个模态的特征在自注意力之前被合并,共同进入Transformer。

2)共同注意力架构(Co-attention):如上图(b),每个输入模态都具备私有自注意力通道,用于模态独立特征的导入,然后再使用共同的交叉注意力层融合多模态特征。

3)交叉注意力架构(Cross-attention):对于多模态任务,将图像与语言分别结合,实现图文信息的相互嵌入与问答。

4)三角Transformer架构(Tangled-transformer):使用三组 Transformer 模块同时处理动作、图形对象和语言特征,通过特定的三角连接关系,注入其他模态的 Transformer 网络,以不同模态的信息融合。

5)模态间对比学习架构(Inter-Modality Contrastive Learning):不同模态的信息被分解,通过矩阵结构建立多模态对比学习关联。

目前评估,OpenAI采用该种交叉注意力架构的研发GPT-4的代价最小,可以大幅度使用ChatGPT中已经构建的语言模块。从笔者团队的分析看,GPT-4很有可能正是采用这类架构。

交叉注意力(Cross-attention)机制将视觉信息直接融合到语言模型解码器的层中,而不是使用图像作为语言模型的附加前缀,交叉注意力将相同维度的独立嵌入序列进行非对称的整合。这类架构可有效地平衡文本生成能力和视觉信息。VisualGPT、VC-GPT和Flamingo等模型也使用这种预训练策略,并使用图像字幕和视觉问答任务进行训练。

关注我,领取九大类别,数百篇 AI 学习资源。

一起学习 ChatAI,掌握 AI 工具,不被时代淘汰。

原文链接:https://blog.csdn.net/fogdragon/article/details/131266675

评论 ( 0 )