数据人下场做内容,当然以数字说话,先看视频号和小红书的数据:

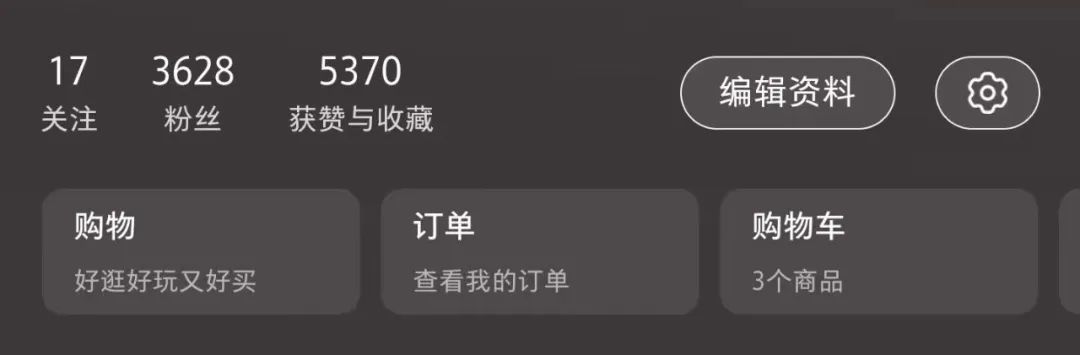

小红书,单篇笔记 4547 个赞,涨粉 3600+

视频号,单条视频 3万观看,1600+赞,涨粉 600+

不得不说,素人做视频号和小红书,正反馈来的真快 !!

今天说一说,这样的 AI 数字人怎么做?以下是极简步骤:

1/ 编剧:我自个儿 2/ 声效:F5-TTS 3/ 视频:PixVerse 4/ 剪辑:剪映 5/ 人物造型:可灵

首先是声音克隆,F5-TTS。这是一款 Github 开源 tts 软件。借助 10s 左右的人声,完美克隆出音色,用来朗读文本。

我本地使用 3060的显卡,虽然够用,但依旧不舍得用它来烧。于是我把 F5-TTS 部署到了谷歌 Colab. 租用 10G 左右的 T4 GPU。使用 Gradio 可以快速把这份软件,发布到外网使用。

人物造型,采用可灵的“文生图”。相比 MidJourney, Stable Diffusion 纷繁复杂的咒语,可灵生图大模型已经完全中文化。用中文去描述一幅图,更符合国人习惯。

图生视频,采用 PixVerse. 一张2D的图,搭配中文的提示词,经过 PixVerse 渲染后,就动起来了。让图中人物笑就笑,哭就哭。惊艳!

但最令人惊艳的部分,是 PixVerse 对口型的功能。中英文语境下,口型完全看不出瑕疵。当然这部分需要一点点费用。但很快,相比带给我的惊喜,这点米就毫不在意了

剪映,已经成为我每日至少用一回的神器了,比 Cursor 用的还勤。用它翻译,做双语字幕,听声辩词,添加 BGM,做转场,特效等等。

我做了一个 AI 视频例子,大家看看效果。并且,还剪了个视频,来演示如何做出这样的 AI 视频。祝大家涨粉快乐

原文链接:https://blog.csdn.net/wujiandao/article/details/145314253?ops_request_misc=%257B%2522request%255Fid%2522%253A%25228a13b6807b7c4ff25d7a0b7ce24c4b0b%2522%252C%2522scm%2522%253A%252220140713.130102334.pc%255Fblog.%2522%257D&request_id=8a13b6807b7c4ff25d7a0b7ce24c4b0b&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~blog~first_rank_ecpm_v1~times_rank-6-145314253-null-null.nonecase&utm_term=midjourney+%E5%92%92%E8%AF%AD

评论 ( 0 )