前言:

最近DeepSeek爆火就不过多介绍了,主打国产且完全免费,公司年后也在让我们得拥抱它,没办法,潮流来了你不用就会OUT,所以弄个专栏来研究一下它,通常我们就会使用官方推出的网页聊天来进行体验:

但是,实际用时,可能是流量太大了,经常会出现这个提示:

因为走了云端的查询,所以不稳定,解决之道很简单,直接在电脑上进行本地化部署【言外之意就是查询就直接走本地电脑了,而不是走DeepSeek的云端服务器】,所以下面咱们来搞定它。

一、准备工作

1. 确认设备要求

-

系统:macOS 12.3或更高版本

-

内存:至少16GB(模型需要8GB以上空闲内存)

-

存储空间:预留10GB以上(模型文件约4-8GB)

二、安装Ollama(模型运行引擎)

步骤1:一键安装

打开终端(Terminal),直接复制粘贴以下命令:

curl -fsSL https://ollama.com/install.sh | sh▶️ 注意:如果提示需要密码,输入你的Mac登录密码(输入时不会显示字符,输完按回车)

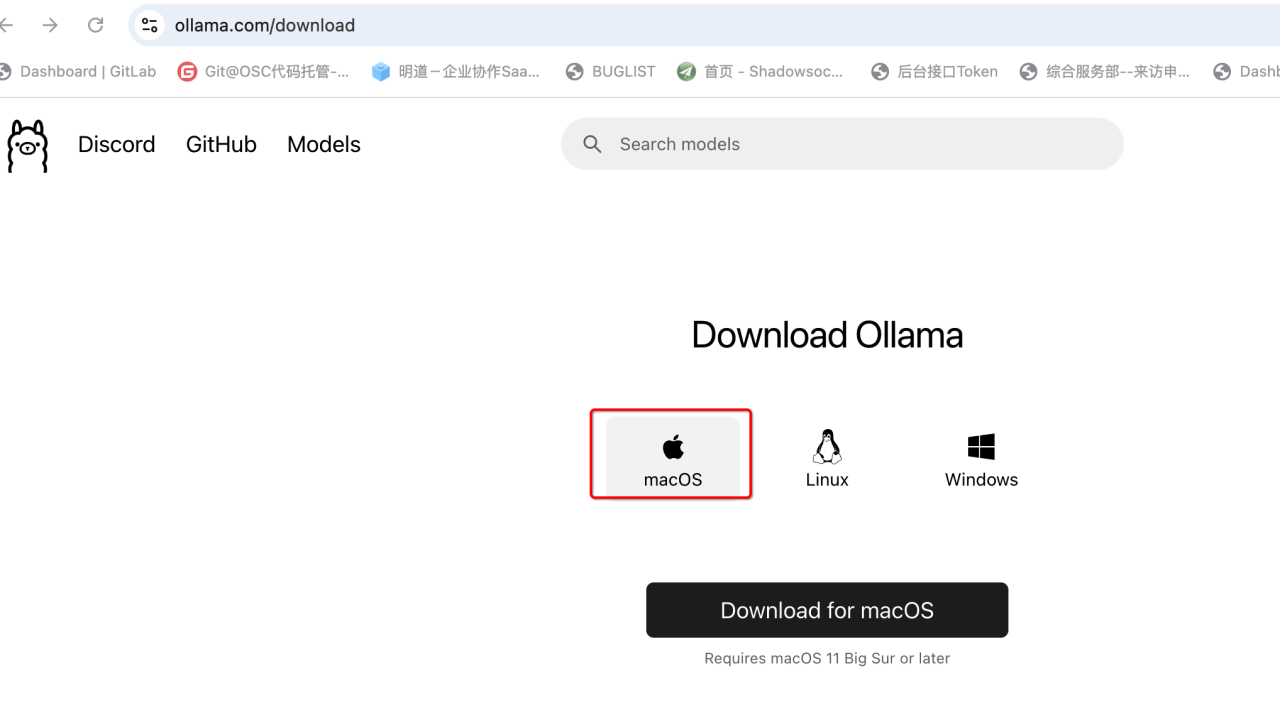

另外还有一种安装方法,就是不用上面的命令,而是直接上ollama的官网下载安装包:

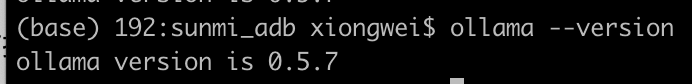

步骤2:验证安装

在终端输入:

ollama --version如果显示类似 ollama version xxx 则安装成功

三、下载DeepSeek模型

步骤1:选择适合的模型版本

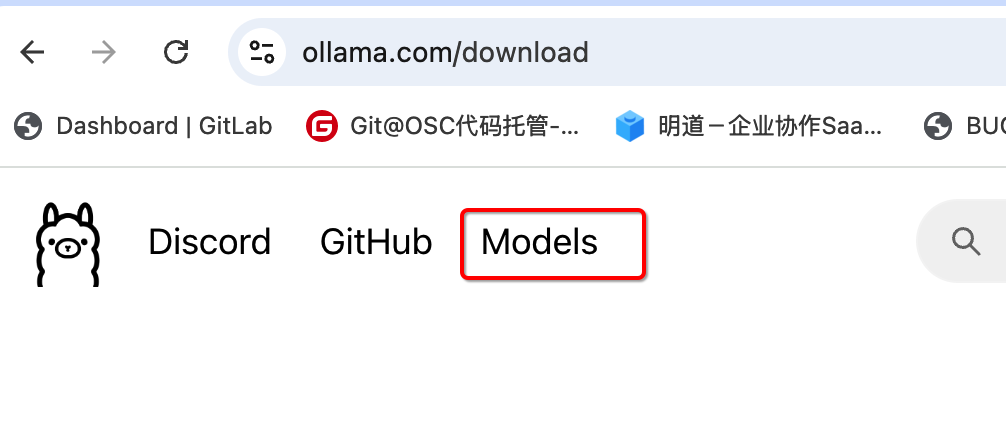

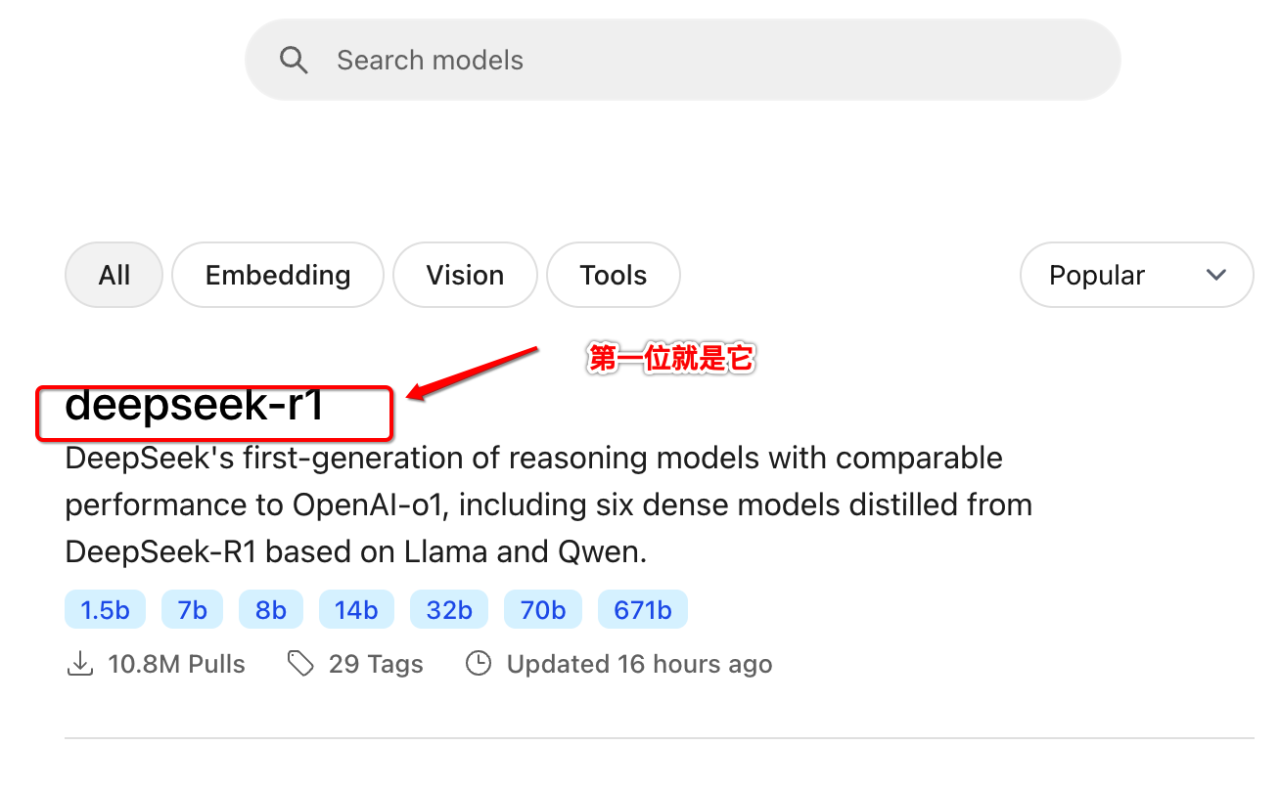

在Ollama网页上这块可以来选择模型:

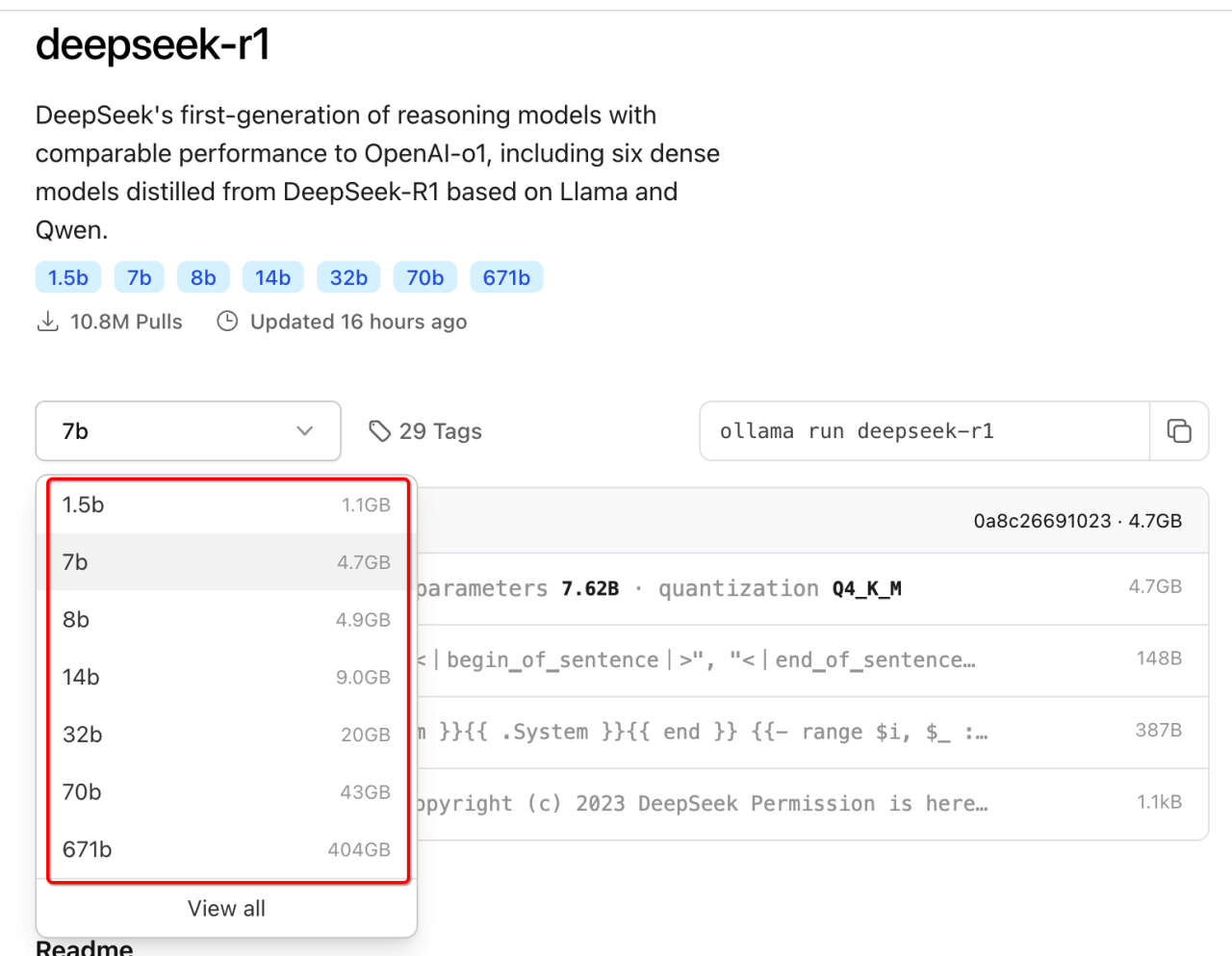

点击进去,可以看到有不同的版本:

那。。到底选哪个版本比较好呢?当然是越高越好啦,但是要求电脑的性能也越高,这里给出一个表格供自由选择:

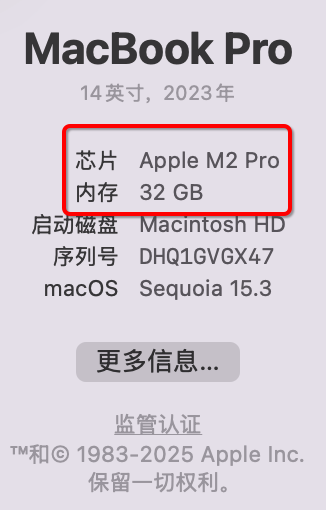

由于我电脑是M2,内存是32GB的:

所以,选择它14b的,为啥要模型呢?以及1.5b、7b、8b、14b、32b、70b有啥区别呢?关于这块打算下一次用专门的一篇来介绍,这篇主要是应用,简单描述可以是:

不同模型名称中的 1.5B、7B、14B 等数字代表模型的参数量(Parameters),这里的 B 是“Billion”(十亿) 的缩写。参数量的多少直接影响模型的“聪明程度”、计算资源需求和适用场景,也不是说越多越好,因为越多其硬件的资源消耗也会越多,得根据自己电脑的情况来定。

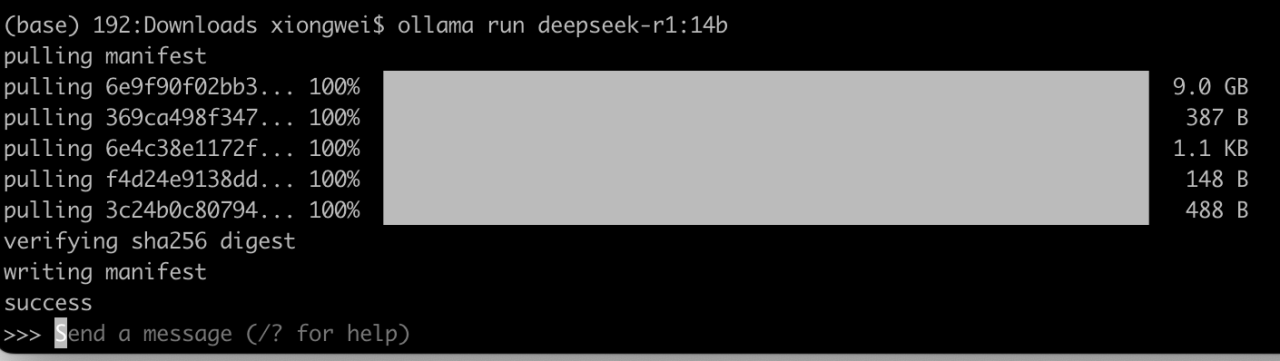

步骤2:等待下载完成

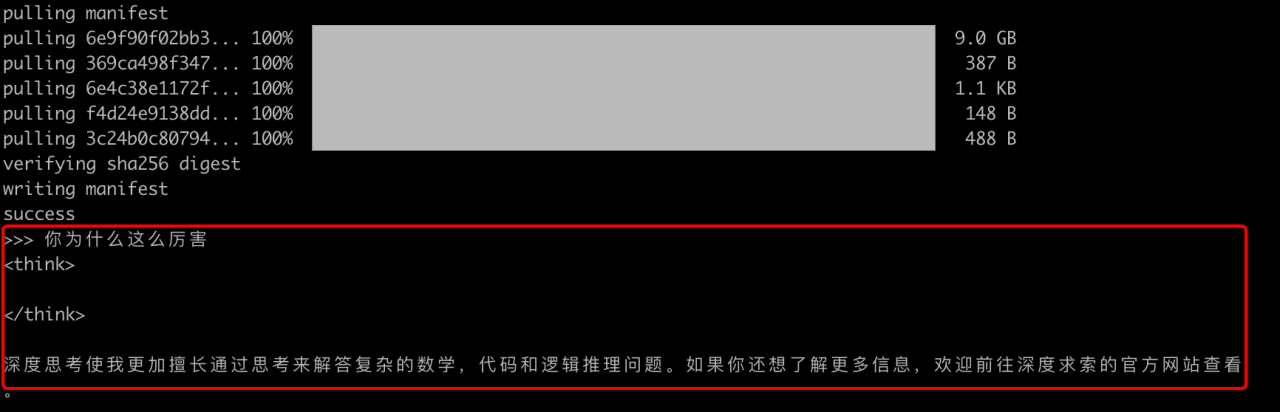

此时可以提一个问题,比如:

此时的问题回答就完全脱离了网络可以本地进行对话了,但是目前这种终端的交互方式不是太友好,所以接下来得借助于另外一个可视化操作的工具,继续往下看。

四、安装Chatbox AI(可视化操作界面)

步骤1:下载安装包

访问官网 https://chatboxai.app 然后进行下载:

当前的版本为:1.9.8

步骤2:连接本地模型

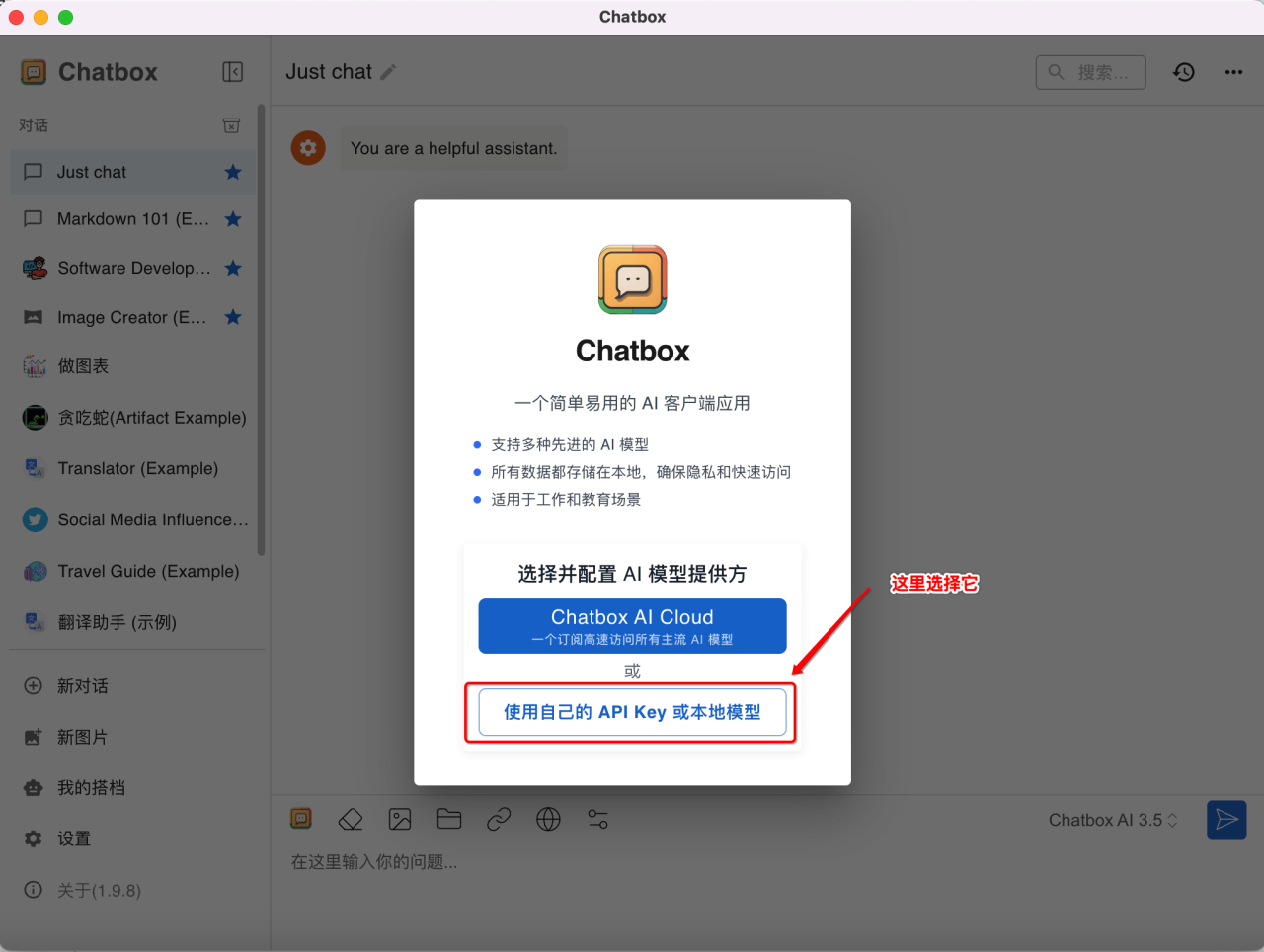

打开Chatbox,此时会让我们进行一个选择:

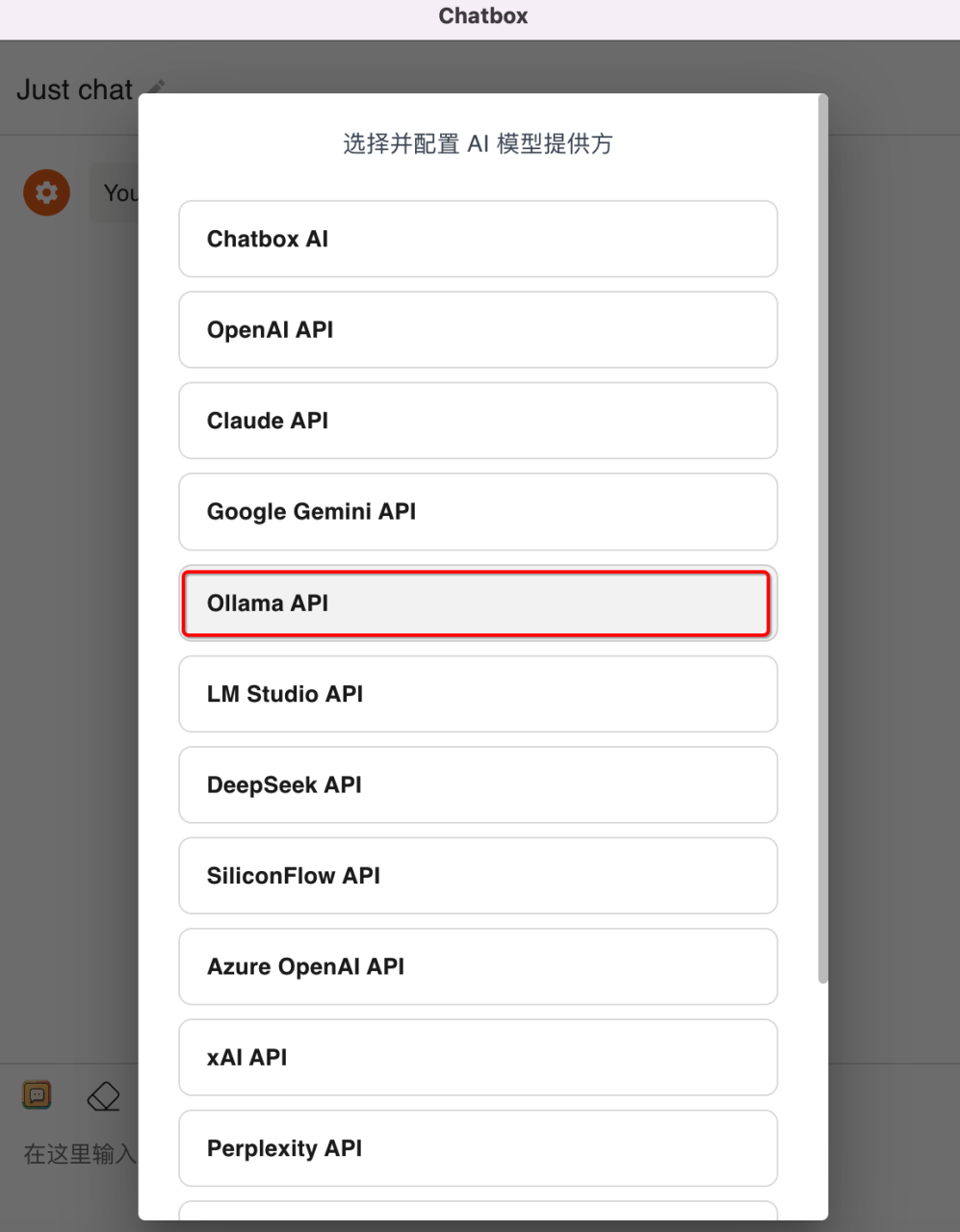

此时会让我们进行一个AI模型的选择,咱们选择它:

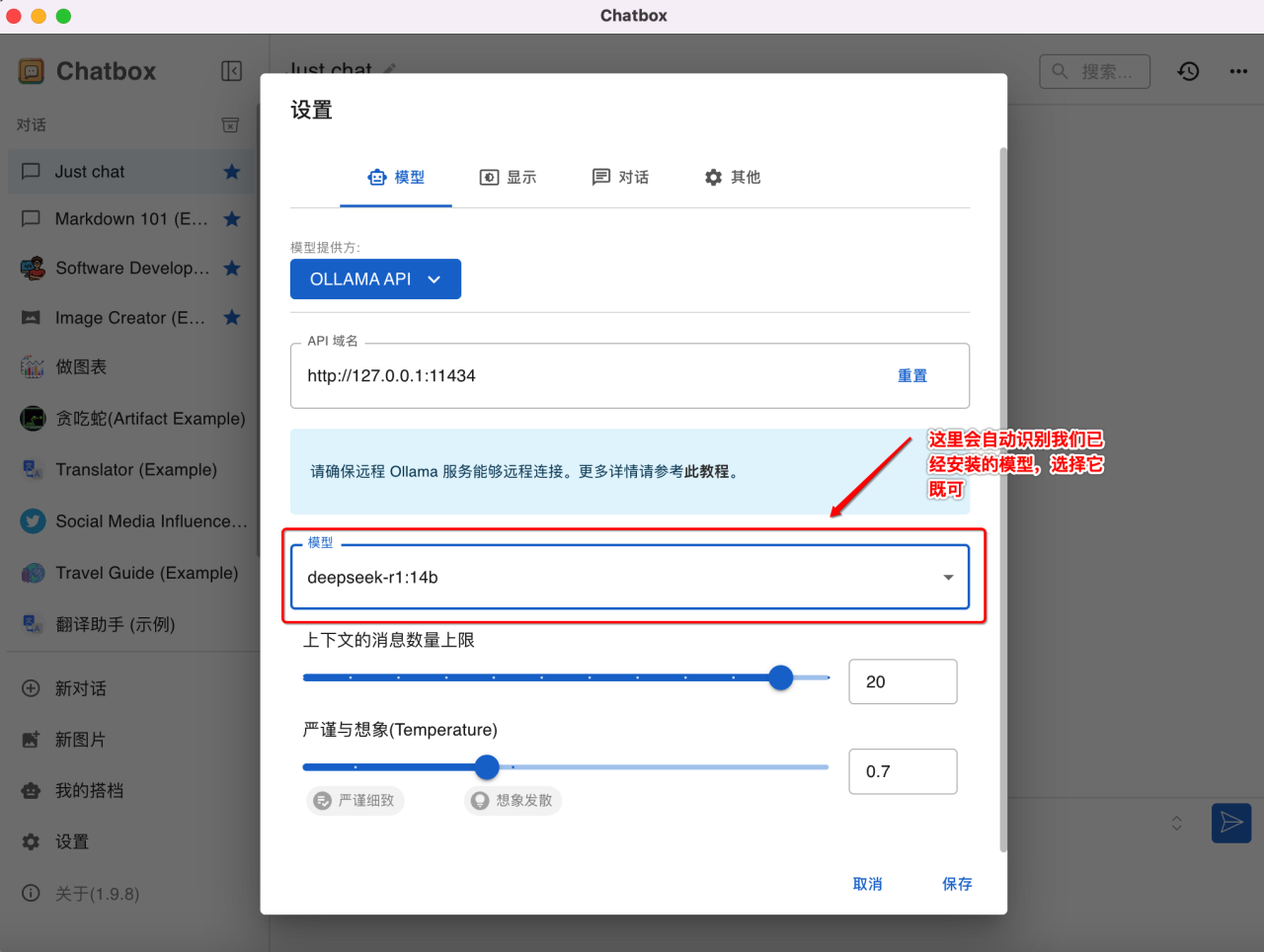

接下来选择咱们已经下载好的deepseek-r1模型:

咱们试一下效果,先把电脑的网给断了,然后提一个问题:

至此,就解决了因为DeepSeek由于服务器不稳定原因造成咱们在使用时经常用不了的问题。

六、常见问题解决

❌ 模型下载卡住

-

尝试更换网络环境

-

手动下载模型(终端输入):

ollama pull deepseek-chat:7b

❌ Chatbox无法连接Ollama

-

检查Ollama是否在运行(终端输入

ollama list应有模型显示) -

重启服务:

ollama serve

❌ 生成速度慢

-

关闭其他占用内存的程序

-

降低模型参数版本(终端输入):

ollama run deepseek-chat:7b

总结:

按照以上步骤操作,30分钟内即可在Mac上搭建完整的本地AI写作助手,所有数据仅在本地运行,无需担心隐私泄露,无网也可以使用,下一次会针对“模型”进行一个小白式的学习,只要提到DeepSeek,都会提到这个词,但是总是让人觉得有些抽像,下次见~~

关注个人公众号,获得实时推送

原文链接:https://blog.csdn.net/webor2006/article/details/145512669?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522f8a11939c81e37469f5a6cbd7f2c5deb%2522%252C%2522scm%2522%253A%252220140713.130102334.pc%255Fblog.%2522%257D&request_id=f8a11939c81e37469f5a6cbd7f2c5deb&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~blog~first_rank_ecpm_v1~times_rank-19-145512669-null-null.nonecase&utm_term=deepseek+%E6%8F%90%E7%A4%BA%E8%AF%8D

评论 ( 0 )