AI芯片是一种专门用于人工智能计算的集成电路。相较于传统的通用微处理器,AI芯片具备更优秀的高性能和低功耗等特点,能够加速训练和推理过程,是目前在人工智能领域广泛应用的重要基础设施之一。

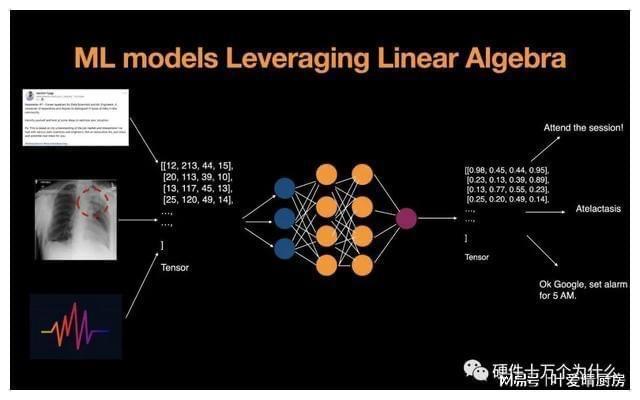

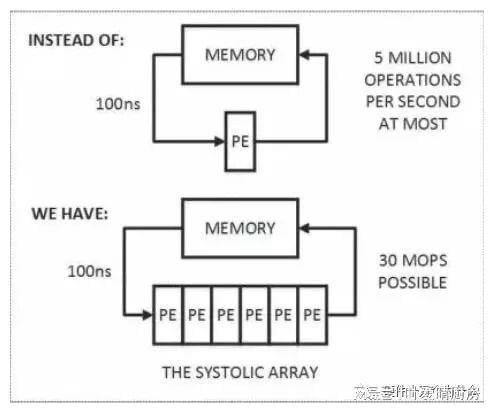

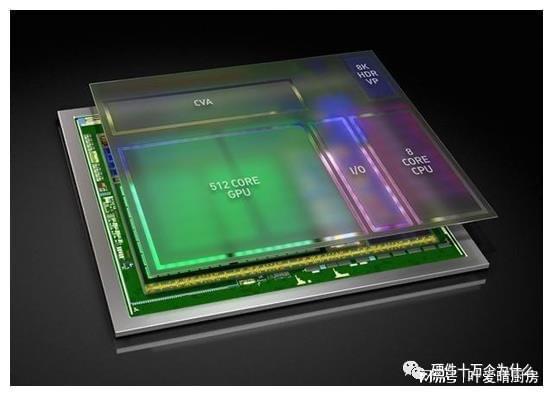

AI芯片的种类有很多,其中最常见的是图形处理单元(GPU)和张量处理单元(TPU)。GPU主要适用于深度学习训练过程中矩阵乘法操作的并行加速,因为它可以同时处理大量数据并具备相对较高的模型精度。而TPU则主要用于推理阶段,凭借着其高效的矩阵加速器和低延迟通信电缆结构,可以快速地进行卷积、池化等常见操作,并且可以执行矩阵多次积累、迭代和分批仿射变换操作,从而显著提高了神经网络代码的运行速度和能源效率。

除此之外,还有像FPGA、ASIC和NPU等芯片类型,也都各自拥有自己的特殊设计来实现对AI算法的优化和加速。

与传统微处理器不同,AI芯片的设计是由算法、储存器等各个应用层面代码需求与硬件计算机组成共同决定的。在许多需要计算密集型任务的场合,比如机器视觉检测、语音识别、自然语言处理和推荐系统等,AI芯片可为用户提供更高效的服务体验,这已经成为了许多技术行业发展的必要条件。

尽管AI芯片具有很强的计算速度和能源效率,但它们仍需要不断改进优化,使其适用于不同的场景,并且使其更加适配多样化的人工智能模型。同时,在与通用微处理器相比较的情形下,AI芯片的设计为用户提供了更广泛而专业的机器测试集开发环境,可以大幅度缩短研发时间和降低成本,因此在人工智能产业的发展中拥有重大的意义。

未来,随着人工智能应用场景不断增加和创新技术的涌现,我们可以预见到,AI芯片的功能和性能将会得到更加广泛的升级和优化,进一步推动了人工智能技术在生命科学、物流管理、城市规划、工业制造和汽车驾驶领域的快速发展。

举报/反馈

原文链接:https://baijiahao.baidu.com/s?id=1766392383592444121&wfr=spider&for=pc

评论 ( 0 )