ChatGPT持续进化,国产版ChatGPT也正在涌现,例如百度的文心一言,复旦大学Moss,清华大学的ChatGLM,但不得不承认,在从整体水平上,我们与ChatGPT还有差距。

但是近日,传出一个消息,瞬间引爆了网络,那就华为盘古新大模型或将于4月发布。

大家对华为,总是有很多期待,那么盘古大模型会不会有更好的表现呢?能否达到甚至超越ChatGPT呢?这些问题都成为众人关注的焦点。

对此,已经有很多机构认为,盘古将对标ChatGPT,或许有机会超过任何其他类似应用的最先进、最强大的自然语言处理应用。

其实早在2021年4月,华为就发布云盘古系列AI大数据模型,而今年要发布的,必定是全新升级的。

盘古大模型其实共有四种,其中,NLP大模型的能力与ChatGPT是同一个类型,它的性能也已经得到证明。

2019年权威的中文语言理解评测基准CLUE榜单中,盘古NLP大模型在总排行榜及分类、阅读理解单项均排名第一,刷新三项榜单世界历史纪录。总排行榜得分83.046,多项子任务得分业界领先,是当时最接近人类理解水平(85.61)的预训练模型。

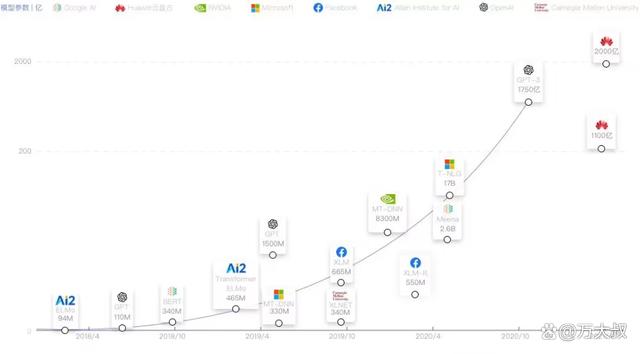

在模型参数方面,高达2000亿,远高于此前的第三代GPT。GPT-1是OpenAI在2018年推出的,模型参数数量为1.17亿。GPT-2,2019年推出,有15亿哥参数。GPT-3,2020年发布,有1750亿个模型参数。

那么最新的GPT-4,说法不一,有说起参数达到1.6万亿个,也有说3.5万亿,5万亿,甚至还有人说是100万亿,这些暂时都不能确定。而华为盘古NLP模型,据说是超过1万亿个参数。所以,也是非常值得期待的。

刚才我们说,盘古大模型公分四个,分别是NLP大模型、CV大模型、多模态大模型以及科学计算大模型(气象大模型)。在华为官网,除了多模态大模型,其他三个都已经被标注为即将上线状态,看了传闻中四月份发布,绝非空穴来风。

另外,相关的大模型已经在金融、气象、工业等多个领域落地应用,下面会讲到。

它是业界首个千亿参数中文语言预训练模型,在预训练阶段学习了40TB中文文本数据,下游应用仅需少量样本和可学习参数即可完成千亿规模大模型的快速微调和下游适配。

盘古NLP大模型可用于内容生成、内容理解等方面,并首次使用Encoder-Decoder架构,兼顾NLP大模型的理解能力和生成能力,保证了模型在不同系统中的嵌入灵活性。

原文链接:https://baijiahao.baidu.com/s?id=1762123212281451180&wfr=spider&for=pc

评论 ( 0 )