一、在Ubuntu服务器上部署DeepSeek模型

要在Ubuntu上通过Ollama安装和使用DeepSeek模型,可以按照以下步骤操作:

安装Ollama

1、使用命令安装Ollama

![]()

命令语句:curl -sSfL https://ollama.com/install.sh | sh

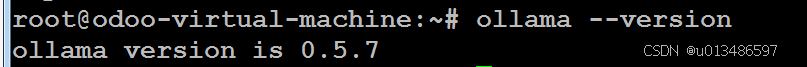

2、验证安装是否成功

安装完之后,您可以通过以下命令验证Ollama是否安装成功

![]()

命令语句:ollama –version

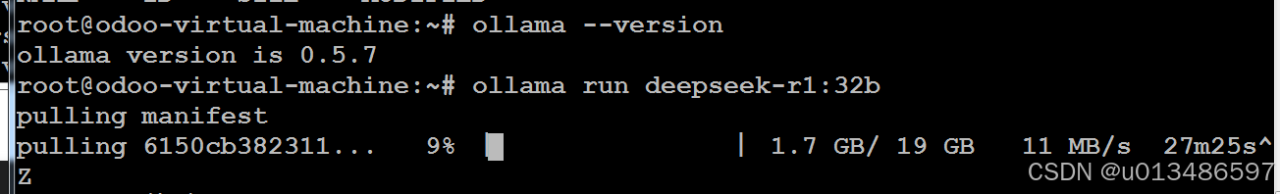

根据自己需求下载需要模型 DeepSeek R1

DeepSeek R1 模型列表

| Model | Base Model | Usage scenario |

| DeepSeek-R1-Distill-Qwen-1.5B | Qwen2.5-Math-1.5B | 适合移动设备或资源受限的终端 |

| DeepSeek-R1-Distill-Qwen-7B | Qwen2.5-Math-7B | 适合普通文本生成工具 |

| DeepSeek-R1-Distill-Llama-8B | Llama-3.1-8B | 适合小型企业日常文本处理 |

| DeepSeek-R1-Distill-Qwen-14B | Qwen2.5-14B | 适合桌面级应用 |

| DeepSeek-R1-Distill-Qwen-32B | Qwen2.5-32B | 适合专业领域知识问答系统 |

| DeepSeek-R1-Distill-Llama-70B | Llama-3.3-70B-Instruct | 适合科研、学术研究等高要求场景 |

DeepSeek R1 电脑配置要求

- 1.5B:CPU最低4核,内存8GB+,硬盘icon3GB+存储空间,显卡icon非必需,若GPU加速可选4GB+显存,适合低资源设备部署等场景。

- 7B:CPU 8核以上,内存16GB+,硬盘8GB+,显卡推荐8GB+显存,可用于本地开发测试等场景。

- 8B:硬件需求与7B相近略高,适合需更高精度的轻量级任务。

- 14B:CPU 12核以上,内存32GB+,硬盘15GB+,显卡16GB+显存,可用于企业级复杂任务等场景。

- 32B:CPU 16核以上,内存64GB+,硬盘30GB+,显卡24GB+显存,适合高精度专业领域任务等场景。

- 70B:CPU 32核以上,内存128GB+,硬盘70GB+,显卡需多卡并行,适合科研机构等进行高复杂度生成任务等场景。

32B 模型在推理基准测试中表现优异,接近 70B 模型的推理能力,但对硬件资源需求更低。

二、配置Ollama服务

二、配置Ollama服务

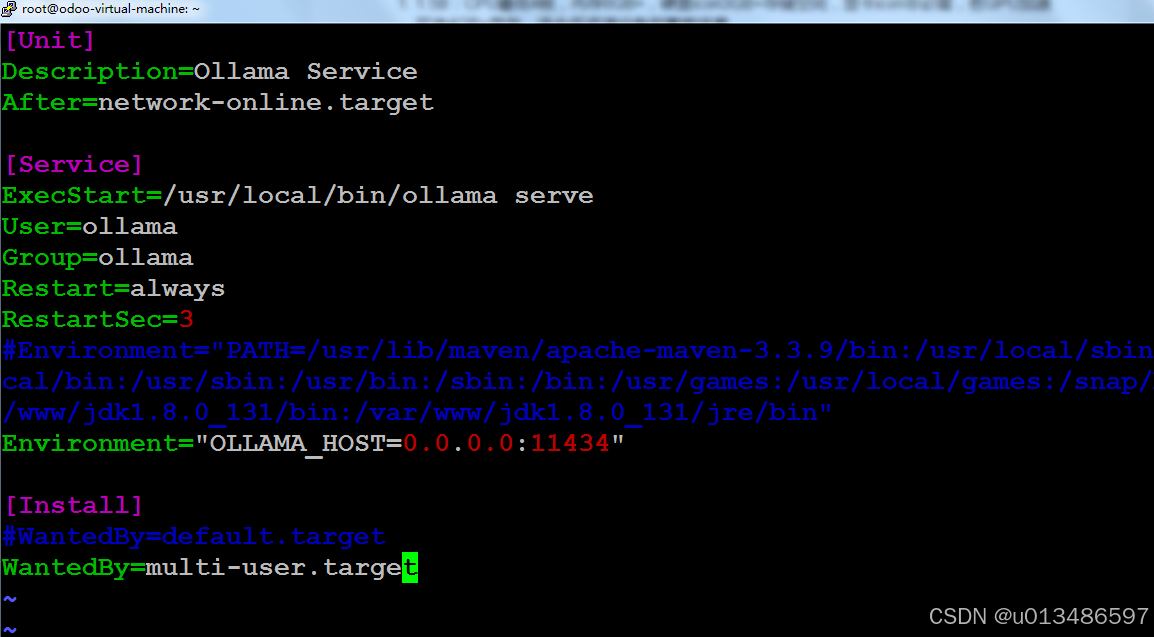

1. 设置Ollama服务配置

设置OLLAMA_HOST=0.0.0.0环境变量,从而允许远程访问。

命令语法:sudo vi /etc/systemd/system/ollama.service

2. 重新加载并重启Ollama服务

2. 重新加载并重启Ollama服务

![]()

命令语法:sudo systemctl daemon-reload sudo systemctl restart ollama

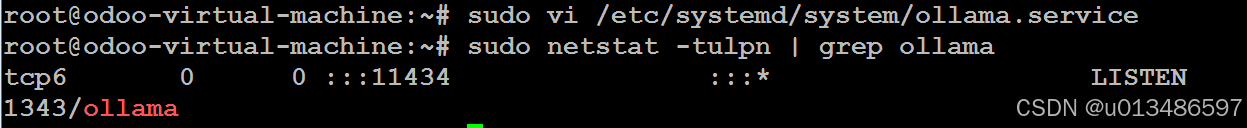

3.验证Ollama服务是否正常运行

运行以下命令,确保Ollama服务正在监听所有网络接口:

命令语法:sudo netstat -tulpn | grep ollama

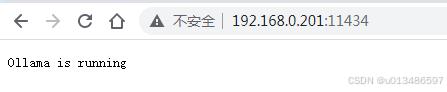

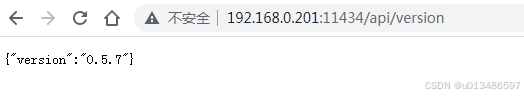

4. 测试远程访问

三、在window上安装Web UI

windows下安装openwebui有三种方式 docker、python+node.js、整合包

非Docker方式安装

1. 安装Python:

下载并安装Python 3.11,建议安装路径中不要包含中文字符,并勾选“Add python 3.11 to Path”选项。

安装完成后,在命令提示符中输入python,若显示Python版本信息则表示安装成功。

2. 安装Node.js和npm:

访问Node.js中文网,下载并安装较新版本的Node.js(如20.12.2),安装过程中会自动安装npm。在命令提示符中输入npm -v,若显示npm版本信息则表示安装成功。

3. 克隆OpenWebUI项目:

打开命令行工具(如CMD、PowerShell或Git Bash),执行以下命令克隆OpenWebUI项目:

git clone https://github.com/open-webui/open-webui.git

导航到OpenWebUI项目目录

4. 安装npm依赖:

npm install

5. 安装Python依赖:

pip install -r ./backend/requirements.txt

(我下载到的项目requirements.txt依赖管理文件在backend目录下,具体看文件路径)

6. 安装uv

macOS/Linux:

curl -LsSf https://astral.sh/uv/install.sh | sh

windows:

powershell -ExecutionPolicy ByPass -c "irm https://astral.sh/uv/install.ps1 | iex"

7. 安装与pip

安装Open WebUI:

pip install open-webui

更新Open WebUI

要更新到最新版本,只需运行:

pip install –upgrade open-webui

8. 运行Open WebUI

通过指定的 Python 版本(3.11)来启动 open-webui 项目,并且将项目的数据存储路径设置为 C:\open-webui\data(示例路径),最后启动该项目的 Web 服务器,以便用户可以通过浏览器访问。

windows powershell:

$env:DATA_DIR="C:\open-webui\data"; uvx –python 3.11 open-webui@latest serve

访问地址:127.0.0.1:8080

此方法安装所有必要的依赖项并启动Open WebUI,允许简单高效的设置。安装后,可以在http://localhost:8080访问Open WebUI。

以后启动可以使用:

open-webui serve或者是在OpenWebUI项目的backend目录下,找到start_windows.bat文件并双击运行。

原文链接:https://blog.csdn.net/u013486597/article/details/145584837?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522ad28640dd4085afb08335a557d672f47%2522%252C%2522scm%2522%253A%252220140713.130102334.pc%255Fblog.%2522%257D&request_id=ad28640dd4085afb08335a557d672f47&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~blog~first_rank_ecpm_v1~times_rank-5-145584837-null-null.nonecase&utm_term=deepseek%E9%83%A8%E7%BD%B2

评论 ( 0 )